著名医師による解説が無料で読めます

すると翻訳の精度が向上します

一般化の行動メカニズムを理解することを目的として、ニューラルネットワークがコンテキストを越えて一般化する能力を分析しました。特定の感覚刺激のセットに対する正しい応答が、異なるコンテキストによって体系的に変化する行動タスクをモデル化しました。正しい応答は、刺激(a、b、c、d)およびコンテキスト象限(1,2,3,4)に依存していました。考えられる16の刺激コンテキストの組み合わせは、2つの応答(x、y)のいずれかに関連付けられており、そのうちの1つは組み合わせの半分で正しいものでした。正しい応答は、コンテキスト全体で対称的に変化しました。これにより、以前に目に見えなかった刺激(プローブ刺激)に対する応答が、以前に提示された刺激から一般化されました。ネットワークが特定のコンテキストで見たことのない2つ以上の刺激でシミュレーションをテストすることにより、他のコンテキストでの正しい応答の知識に基づいて、新規刺激の正しい応答を生成できるかどうかをテストできます。この一般化能力は、Deep Beliedネットワーク(DBN)、多層Perceptron(MLP)ネットワーク、およびDBNと線形パーセプトロン(LP)の組み合わせでテストしました。全体として、DBNとLPの組み合わせは、一般化の成功率が最も高かった。

一般化の行動メカニズムを理解することを目的として、ニューラルネットワークがコンテキストを越えて一般化する能力を分析しました。特定の感覚刺激のセットに対する正しい応答が、異なるコンテキストによって体系的に変化する行動タスクをモデル化しました。正しい応答は、刺激(a、b、c、d)およびコンテキスト象限(1,2,3,4)に依存していました。考えられる16の刺激コンテキストの組み合わせは、2つの応答(x、y)のいずれかに関連付けられており、そのうちの1つは組み合わせの半分で正しいものでした。正しい応答は、コンテキスト全体で対称的に変化しました。これにより、以前に目に見えなかった刺激(プローブ刺激)に対する応答が、以前に提示された刺激から一般化されました。ネットワークが特定のコンテキストで見たことのない2つ以上の刺激でシミュレーションをテストすることにより、他のコンテキストでの正しい応答の知識に基づいて、新規刺激の正しい応答を生成できるかどうかをテストできます。この一般化能力は、Deep Beliedネットワーク(DBN)、多層Perceptron(MLP)ネットワーク、およびDBNと線形パーセプトロン(LP)の組み合わせでテストしました。全体として、DBNとLPの組み合わせは、一般化の成功率が最も高かった。

With the goal of understanding behavioral mechanisms of generalization, we analyzed the ability of neural networks to generalize across context. We modeled a behavioral task where the correct responses to a set of specific sensory stimuli varied systematically across different contexts. The correct response depended on the stimulus (A,B,C,D) and context quadrant (1,2,3,4). The possible 16 stimulus-context combinations were associated with one of two responses (X,Y), one of which was correct for half of the combinations. The correct responses varied symmetrically across contexts. This allowed responses to previously unseen stimuli (probe stimuli) to be generalized from stimuli that had been presented previously. By testing the simulation on two or more stimuli that the network had never seen in a particular context, we could test whether the correct response on the novel stimuli could be generated based on knowledge of the correct responses in other contexts. We tested this generalization capability with a Deep Belief Network (DBN), Multi-Layer Perceptron (MLP) network, and the combination of a DBN with a linear perceptron (LP). Overall, the combination of the DBN and LP had the highest success rate for generalization.

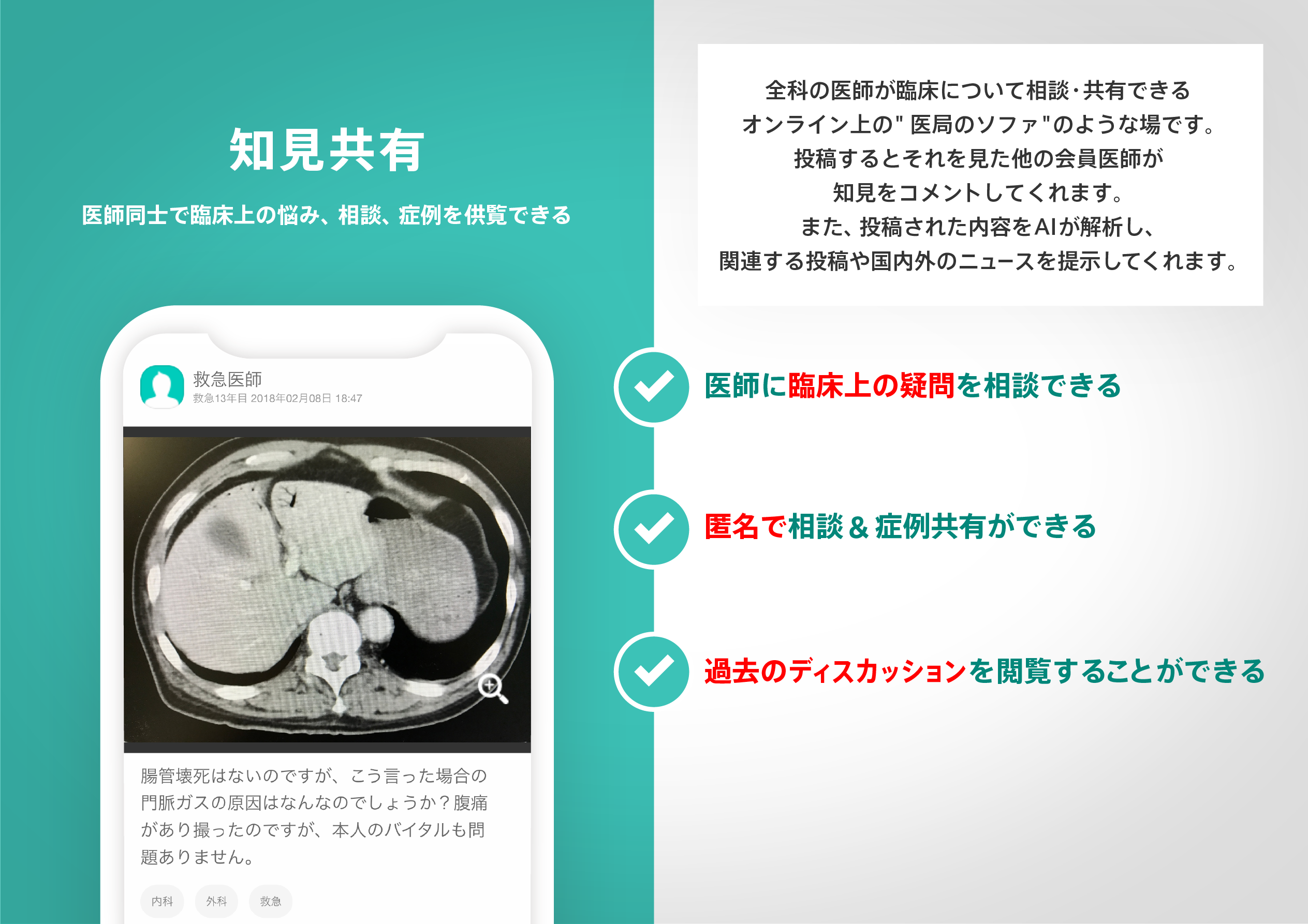

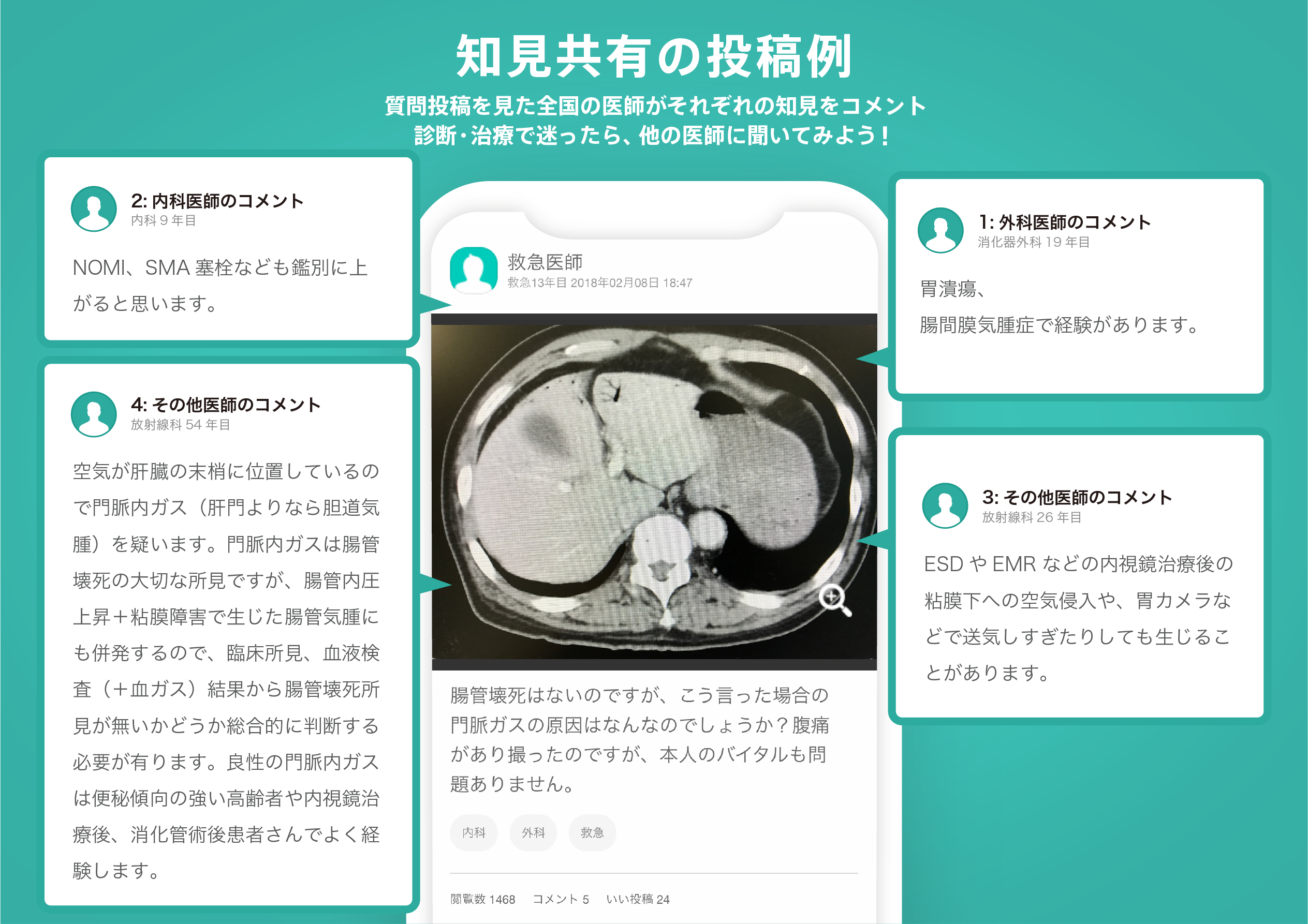

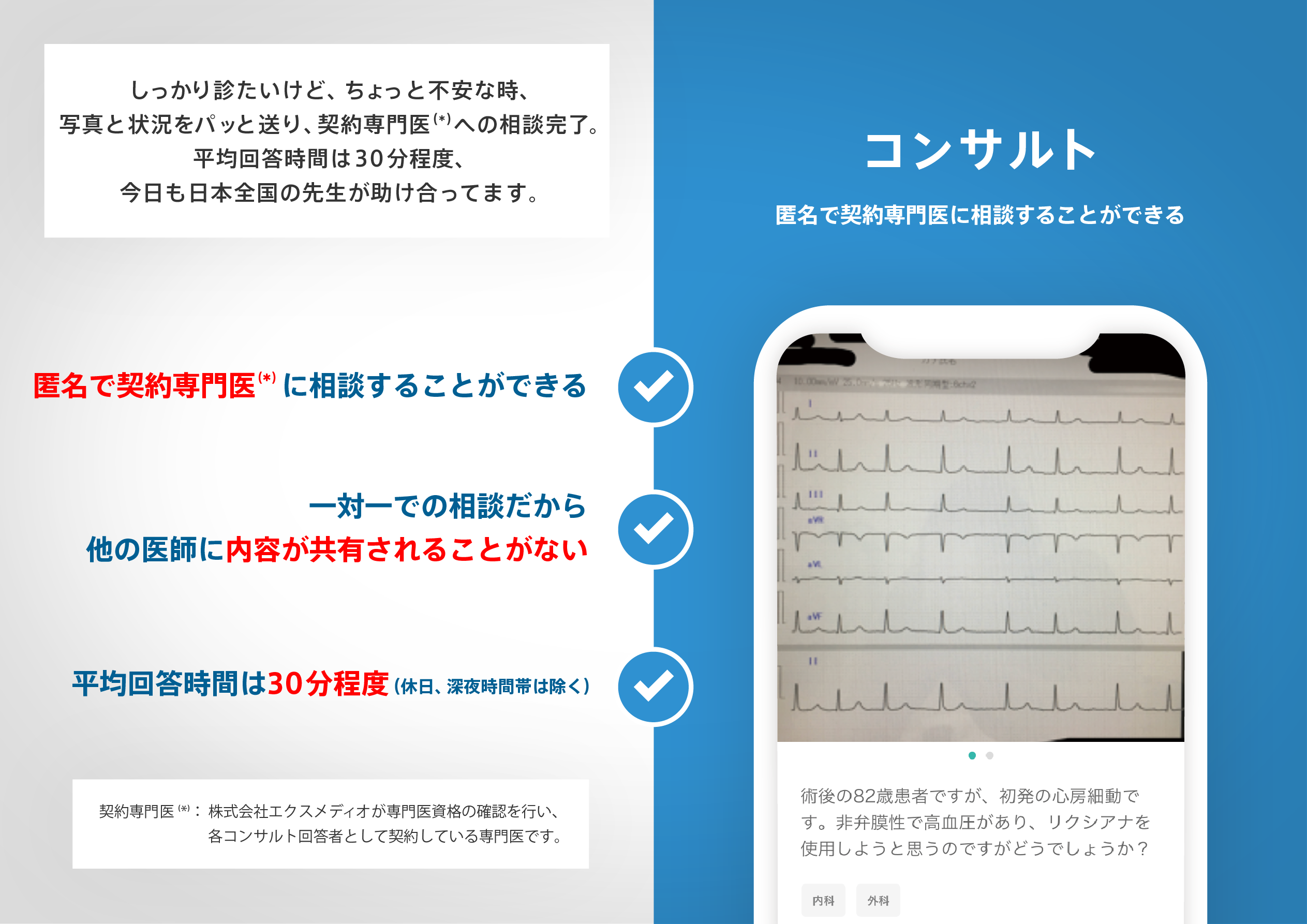

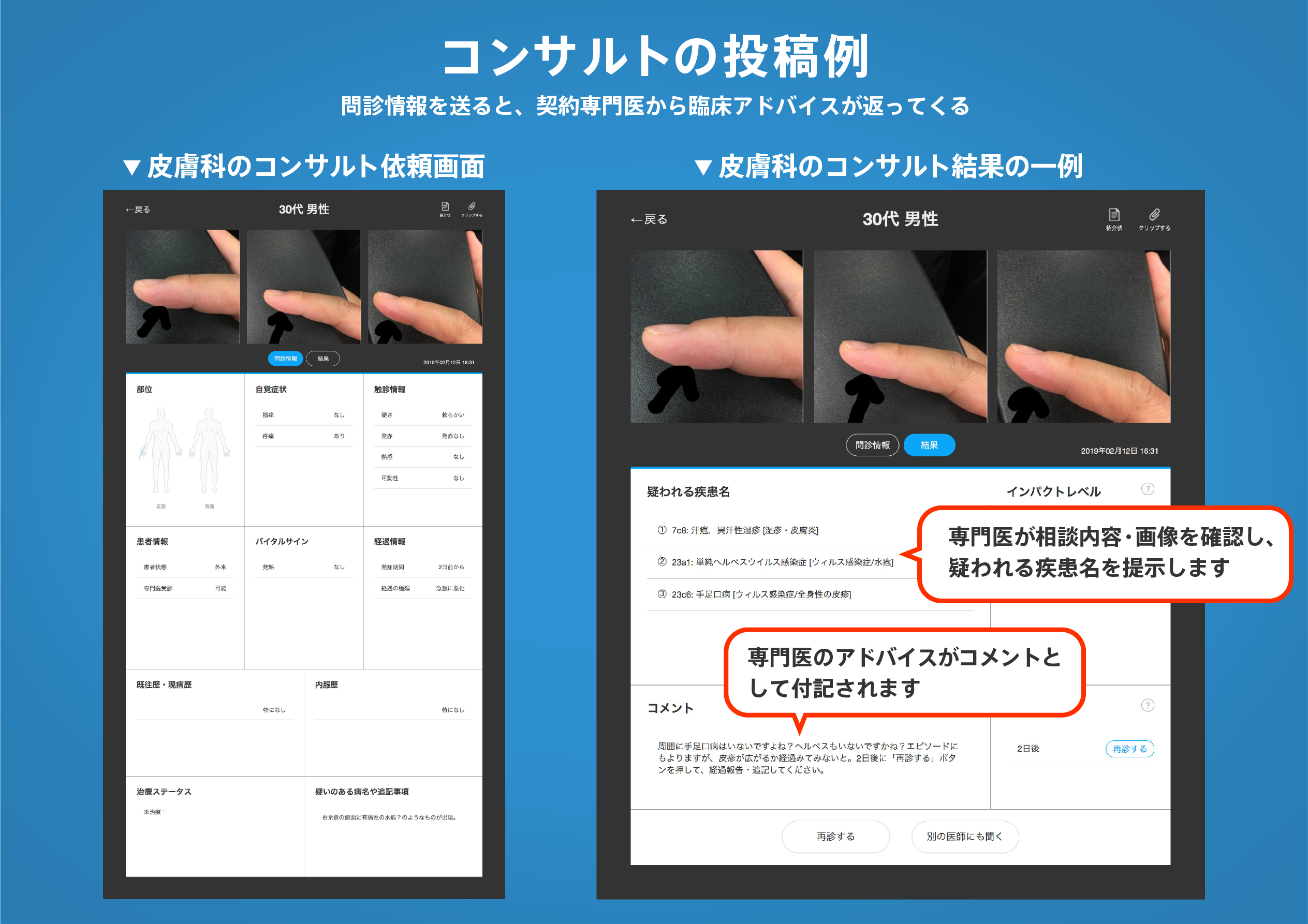

医師のための臨床サポートサービス

ヒポクラ x マイナビのご紹介

無料会員登録していただくと、さらに便利で効率的な検索が可能になります。