著名医師による解説が無料で読めます

すると翻訳の精度が向上します

識別モチーフ発見(DMD)メソッドは、ハイスループットの実験データからモチーフを引き出すことを約束していますが、通常、正確性を犠牲にしなければならず、大きなデータセットの可能性を完全に活用できない可能性があります。最近、DMDによって識別されるモチーフは、排出されたモチーフのパフォーマンスをランク付けするために文献で広く使用されているレシーバー操作特性曲線(AUC)メトリックを最大化することにより、大幅に改善できることが実証されています。ただし、モチーフ洗練のための既存のアプローチは、非凸および不連続AUC自体を直接最大化することを選択します。この論文では、規制モチーフを改良するための大規模なマージン型アルゴリズムである大きなマージンモチーフオプティマイザー(LMMO)を提案します。代理凸ヒンジの損失でAUCコスト関数をリラックスさせることにより、結果の学習問題を、違いの差異(DC)プログラムのインスタンスとしてキャストできることを示し、制約されたConcave-Convexプロシージャ(CCCP)を使用して繰り返し解決します。計算時間をさらに節約するために、LMMOと既存の手法を組み合わせて、プレーンメソッドを切断するなど、大規模なマージン型アルゴリズムのスケーラビリティを改善します。合成および実際のデータに関する実験的評価は、提案されたアプローチのパフォーマンスを示しています。LMMOのコードは、https://github.com/ekffar/lmmoで無料で入手できます。

識別モチーフ発見(DMD)メソッドは、ハイスループットの実験データからモチーフを引き出すことを約束していますが、通常、正確性を犠牲にしなければならず、大きなデータセットの可能性を完全に活用できない可能性があります。最近、DMDによって識別されるモチーフは、排出されたモチーフのパフォーマンスをランク付けするために文献で広く使用されているレシーバー操作特性曲線(AUC)メトリックを最大化することにより、大幅に改善できることが実証されています。ただし、モチーフ洗練のための既存のアプローチは、非凸および不連続AUC自体を直接最大化することを選択します。この論文では、規制モチーフを改良するための大規模なマージン型アルゴリズムである大きなマージンモチーフオプティマイザー(LMMO)を提案します。代理凸ヒンジの損失でAUCコスト関数をリラックスさせることにより、結果の学習問題を、違いの差異(DC)プログラムのインスタンスとしてキャストできることを示し、制約されたConcave-Convexプロシージャ(CCCP)を使用して繰り返し解決します。計算時間をさらに節約するために、LMMOと既存の手法を組み合わせて、プレーンメソッドを切断するなど、大規模なマージン型アルゴリズムのスケーラビリティを改善します。合成および実際のデータに関する実験的評価は、提案されたアプローチのパフォーマンスを示しています。LMMOのコードは、https://github.com/ekffar/lmmoで無料で入手できます。

Although discriminative motif discovery (DMD) methods are promising for eliciting motifs from high-throughput experimental data, they usually have to sacrifice accuracy and may fail to fully leverage the potential of large datasets. Recently, it has been demonstrated that the motifs identified by DMDs can be significantly improved by maximizing the receiver-operating characteristic curve (AUC) metric, which has been widely used in the literature to rank the performance of elicited motifs. However, existing approaches for motif refinement choose to directly maximize the non-convex and discontinuous AUC itself, which is known to be difficult and may lead to suboptimal solutions. In this paper, we propose Large Margin Motif Optimizer (LMMO), a large-margin-type algorithm for refining regulatory motifs. By relaxing the AUC cost function with the surrogate convex hinge loss, we show that the resultant learning problem can be cast as an instance of difference-of-convex (DC) programs, and solve it iteratively using constrained concave-convex procedure (CCCP). To further save computational time, we combine LMMO with existing techniques for improving the scalability of large-margin-type algorithms, such as cutting plane method. Experimental evaluations on synthetic and real data illustrate the performance of the proposed approach. The code of LMMO is freely available at: https://github.com/ekffar/LMMO.

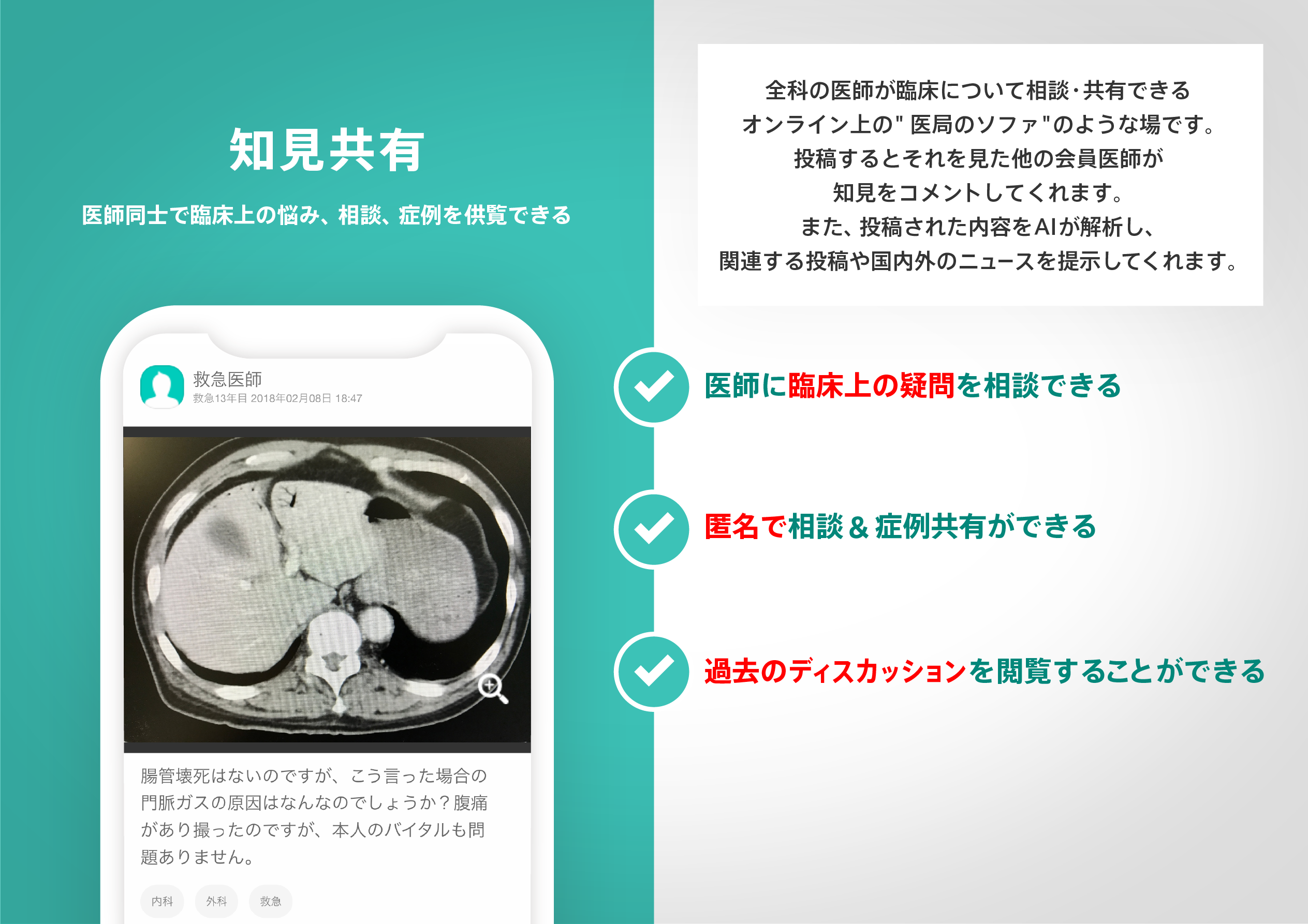

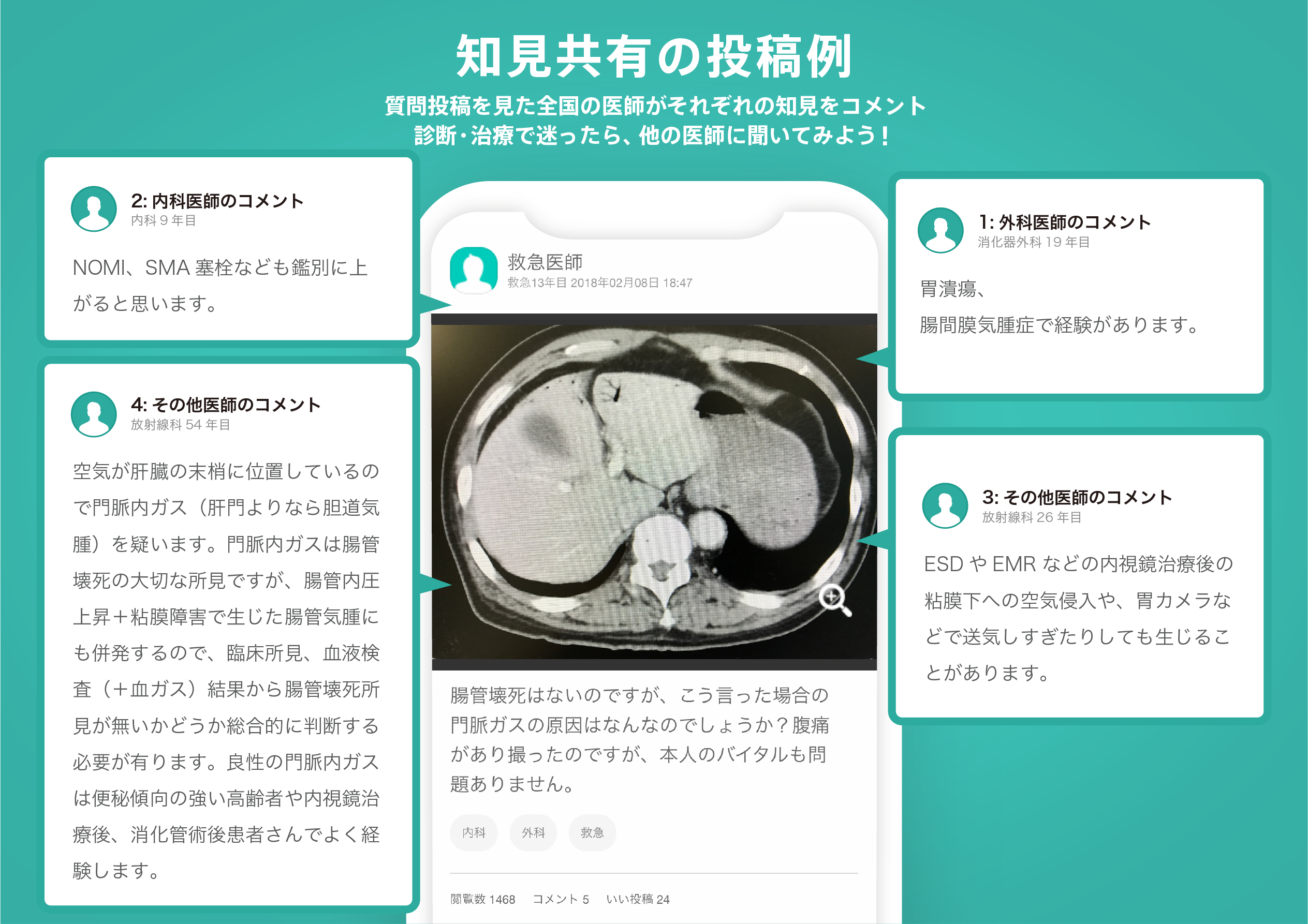

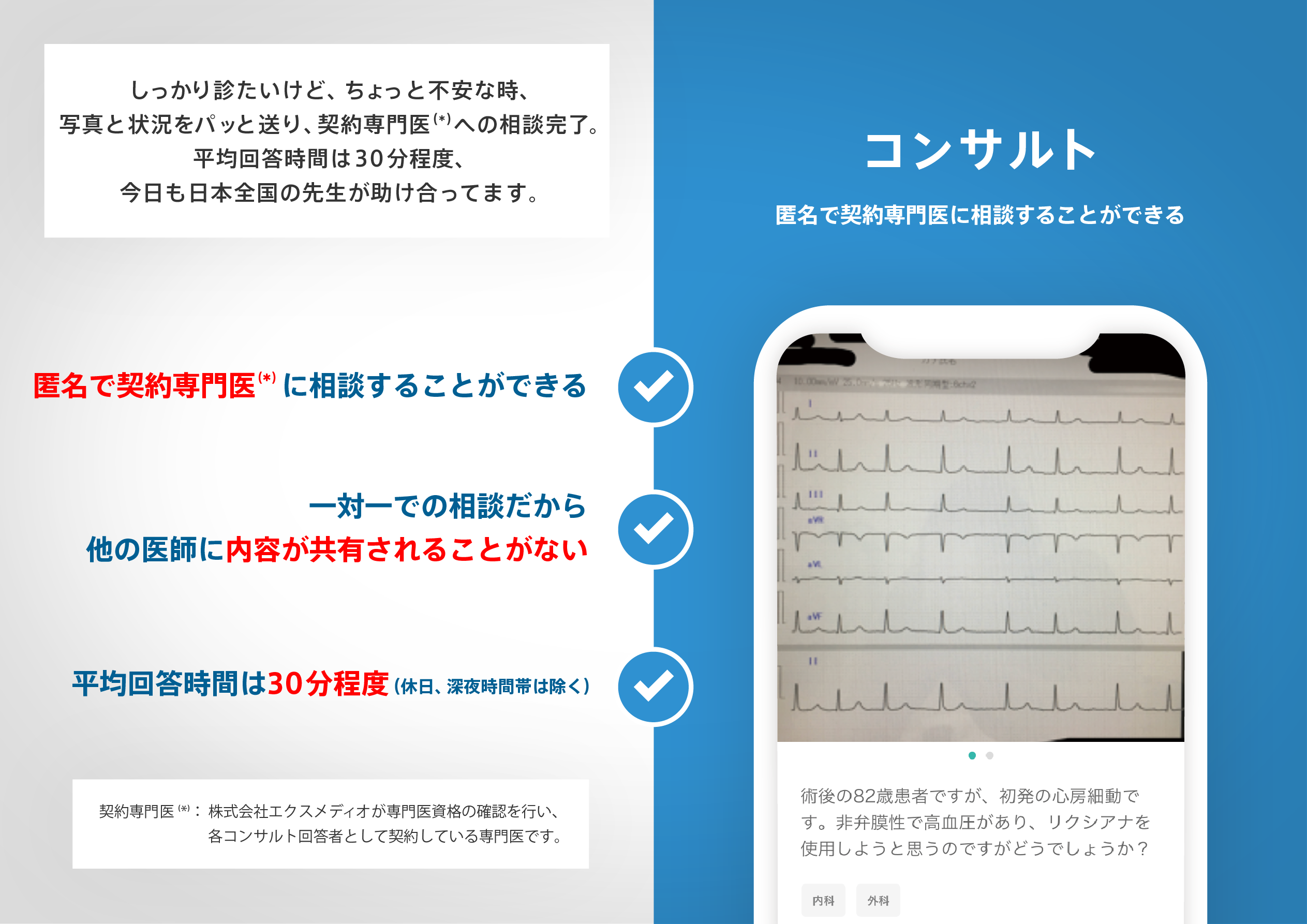

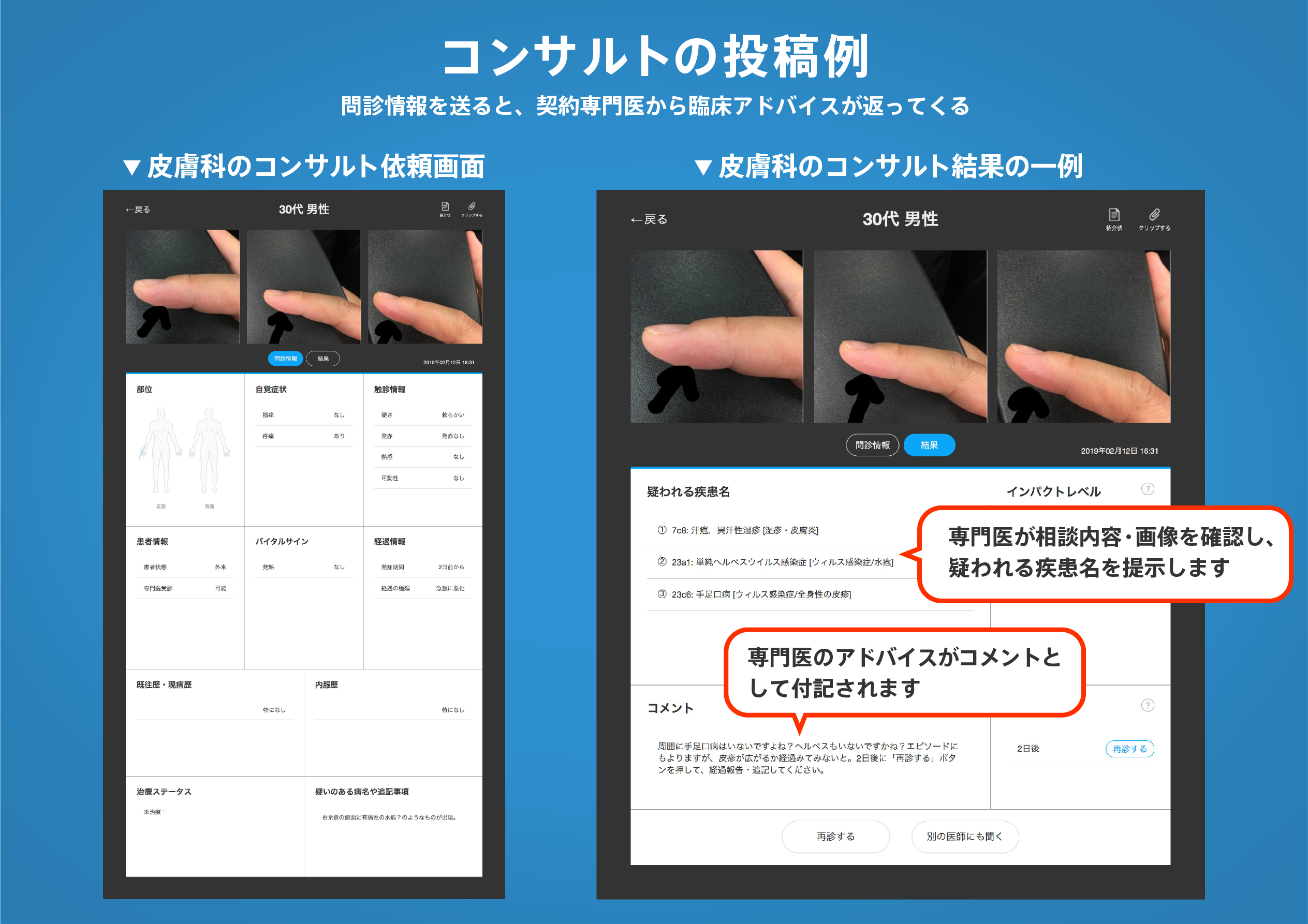

医師のための臨床サポートサービス

ヒポクラ x マイナビのご紹介

無料会員登録していただくと、さらに便利で効率的な検索が可能になります。