著名医師による解説が無料で読めます

すると翻訳の精度が向上します

ニューラルシステムの計算および認知特性は、しばしば(確率的)ネットワークダイナミクスの観点から実装されると考えられています。したがって、複数の単一ユニットの記録やニューロイメージングデータなど、実験的に観察されたニューロン時系列からシステムのダイナミクスを回復することは、その計算を理解するための重要なステップです。理想的には、ダイナミクスの(低次元の)状態空間表現を求めるだけでなく、統計的特性とその生成方程式にアクセスして、詳細な分析を求めることを望みます。再発性ニューラルネットワーク(RNN)は、計算と動的に動的に普遍的な形式的フレームワークであり、計算システムと動的システムの両方の観点から広く研究されています。ここでは、基礎となる潜在的ダイナミクスと観測プロセスの両方のノイズを説明する状態空間モデルの統計的枠組みの中で、区分的線形RNNS(PLRNNS)の半分析的最大尤度推定スキームを開発します。期待最大化アルゴリズムは、グローバルなラプラス近似を介して潜在状態分布を推測し、PLRNNパラメーターを繰り返し推測するために使用されます。おもちゃの例の手順を検証し、比較のために粒子フィルターを介して推論を使用した後、このアプローチは、古典的な作業記憶タスクの性能中に得られたげっ歯類の前帯状皮質(ACC)からの複数の単一ユニット記録に適用され、代替の遅延があります。カーネルの滑らかなスパイク時間データから推定されたモデルは、刺激選択の遅延アクティビティを含むタスクパフォーマンスの基礎となる必須の計算ダイナミクスをキャプチャすることができました。しかし、推定されたモデルはめったに多安定ではありませんでしたが、分岐点の近くで遅いダイナミクスを示すように調整されました。要約すると、現在の研究は、観測されたニューロン時系列の基礎となる非線形ダイナミクスの関連する側面を回復することを可能にするPLRNNの半分析的(したがって、かなり高速な)最大尤度推定フレームワークを進め、これらを計算特性に直接リンクします。

ニューラルシステムの計算および認知特性は、しばしば(確率的)ネットワークダイナミクスの観点から実装されると考えられています。したがって、複数の単一ユニットの記録やニューロイメージングデータなど、実験的に観察されたニューロン時系列からシステムのダイナミクスを回復することは、その計算を理解するための重要なステップです。理想的には、ダイナミクスの(低次元の)状態空間表現を求めるだけでなく、統計的特性とその生成方程式にアクセスして、詳細な分析を求めることを望みます。再発性ニューラルネットワーク(RNN)は、計算と動的に動的に普遍的な形式的フレームワークであり、計算システムと動的システムの両方の観点から広く研究されています。ここでは、基礎となる潜在的ダイナミクスと観測プロセスの両方のノイズを説明する状態空間モデルの統計的枠組みの中で、区分的線形RNNS(PLRNNS)の半分析的最大尤度推定スキームを開発します。期待最大化アルゴリズムは、グローバルなラプラス近似を介して潜在状態分布を推測し、PLRNNパラメーターを繰り返し推測するために使用されます。おもちゃの例の手順を検証し、比較のために粒子フィルターを介して推論を使用した後、このアプローチは、古典的な作業記憶タスクの性能中に得られたげっ歯類の前帯状皮質(ACC)からの複数の単一ユニット記録に適用され、代替の遅延があります。カーネルの滑らかなスパイク時間データから推定されたモデルは、刺激選択の遅延アクティビティを含むタスクパフォーマンスの基礎となる必須の計算ダイナミクスをキャプチャすることができました。しかし、推定されたモデルはめったに多安定ではありませんでしたが、分岐点の近くで遅いダイナミクスを示すように調整されました。要約すると、現在の研究は、観測されたニューロン時系列の基礎となる非線形ダイナミクスの関連する側面を回復することを可能にするPLRNNの半分析的(したがって、かなり高速な)最大尤度推定フレームワークを進め、これらを計算特性に直接リンクします。

The computational and cognitive properties of neural systems are often thought to be implemented in terms of their (stochastic) network dynamics. Hence, recovering the system dynamics from experimentally observed neuronal time series, like multiple single-unit recordings or neuroimaging data, is an important step toward understanding its computations. Ideally, one would not only seek a (lower-dimensional) state space representation of the dynamics, but would wish to have access to its statistical properties and their generative equations for in-depth analysis. Recurrent neural networks (RNNs) are a computationally powerful and dynamically universal formal framework which has been extensively studied from both the computational and the dynamical systems perspective. Here we develop a semi-analytical maximum-likelihood estimation scheme for piecewise-linear RNNs (PLRNNs) within the statistical framework of state space models, which accounts for noise in both the underlying latent dynamics and the observation process. The Expectation-Maximization algorithm is used to infer the latent state distribution, through a global Laplace approximation, and the PLRNN parameters iteratively. After validating the procedure on toy examples, and using inference through particle filters for comparison, the approach is applied to multiple single-unit recordings from the rodent anterior cingulate cortex (ACC) obtained during performance of a classical working memory task, delayed alternation. Models estimated from kernel-smoothed spike time data were able to capture the essential computational dynamics underlying task performance, including stimulus-selective delay activity. The estimated models were rarely multi-stable, however, but rather were tuned to exhibit slow dynamics in the vicinity of a bifurcation point. In summary, the present work advances a semi-analytical (thus reasonably fast) maximum-likelihood estimation framework for PLRNNs that may enable to recover relevant aspects of the nonlinear dynamics underlying observed neuronal time series, and directly link these to computational properties.

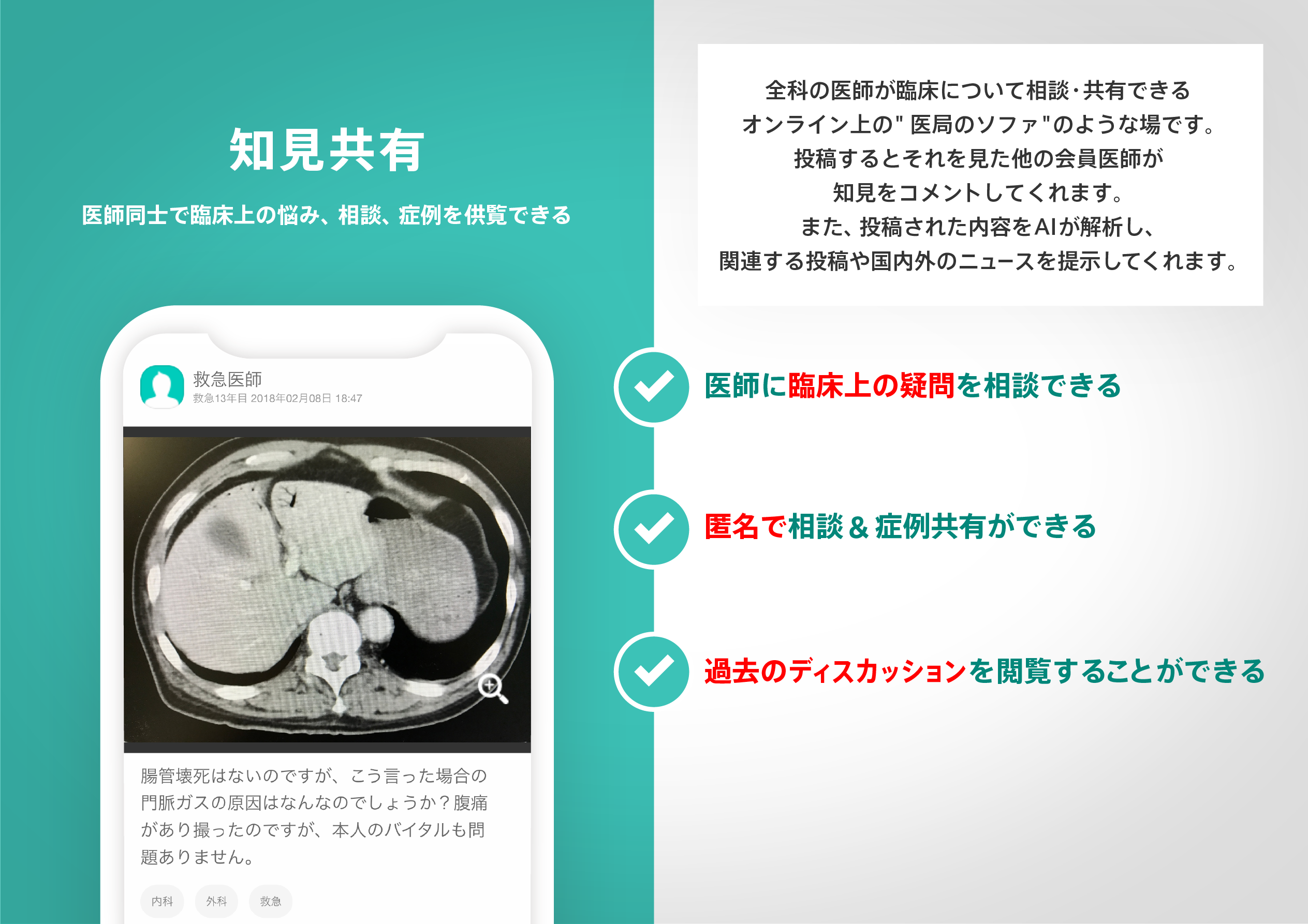

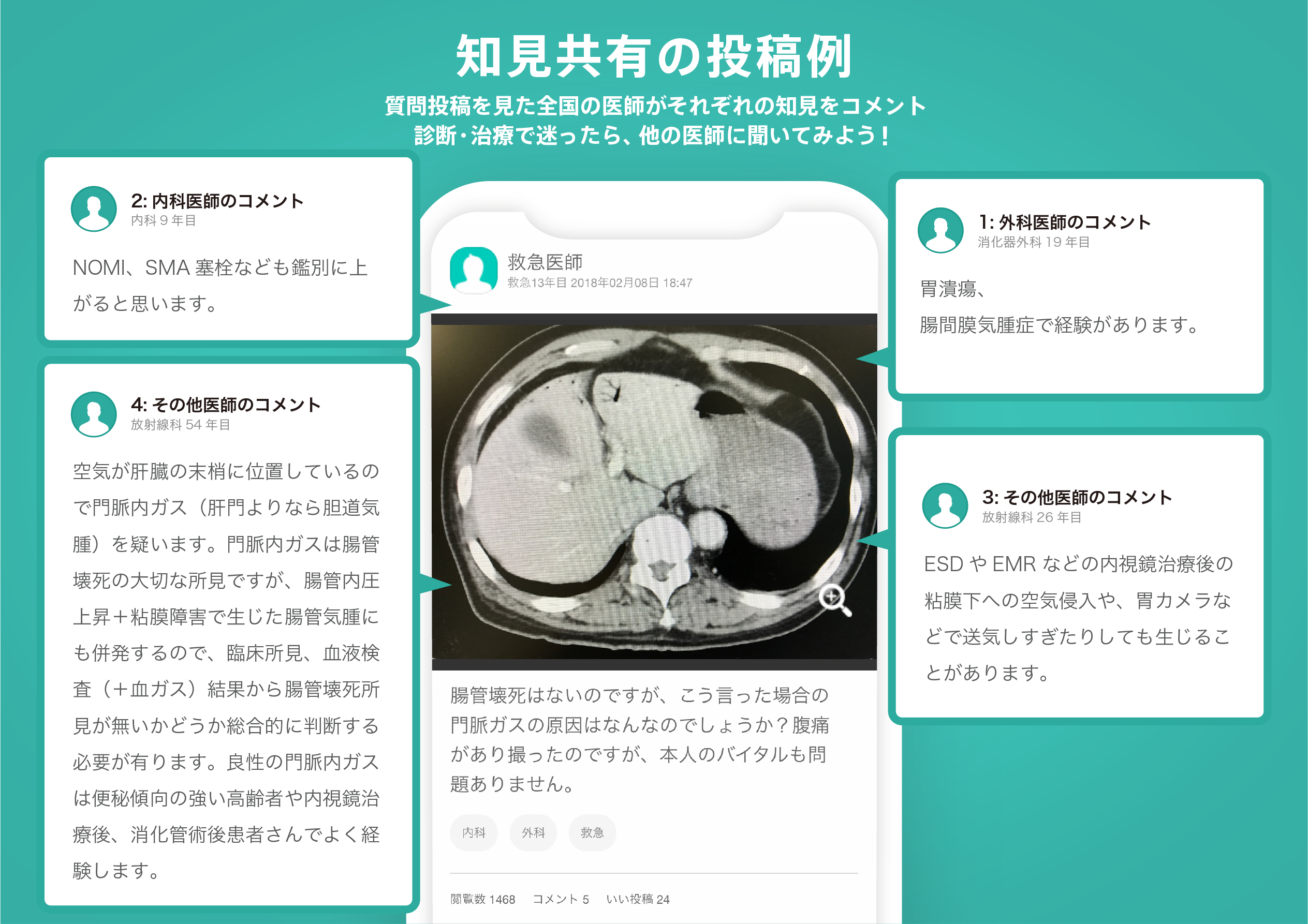

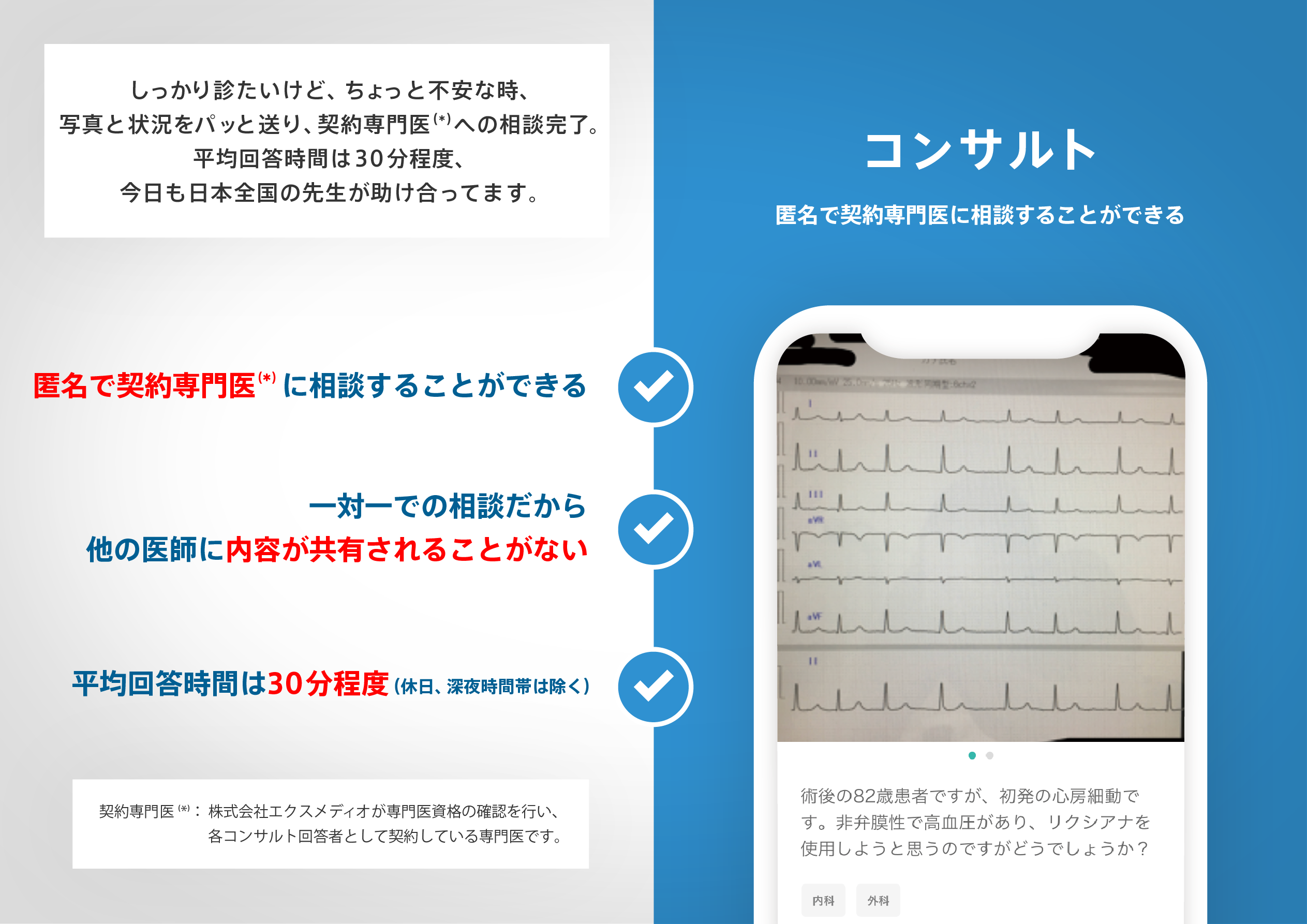

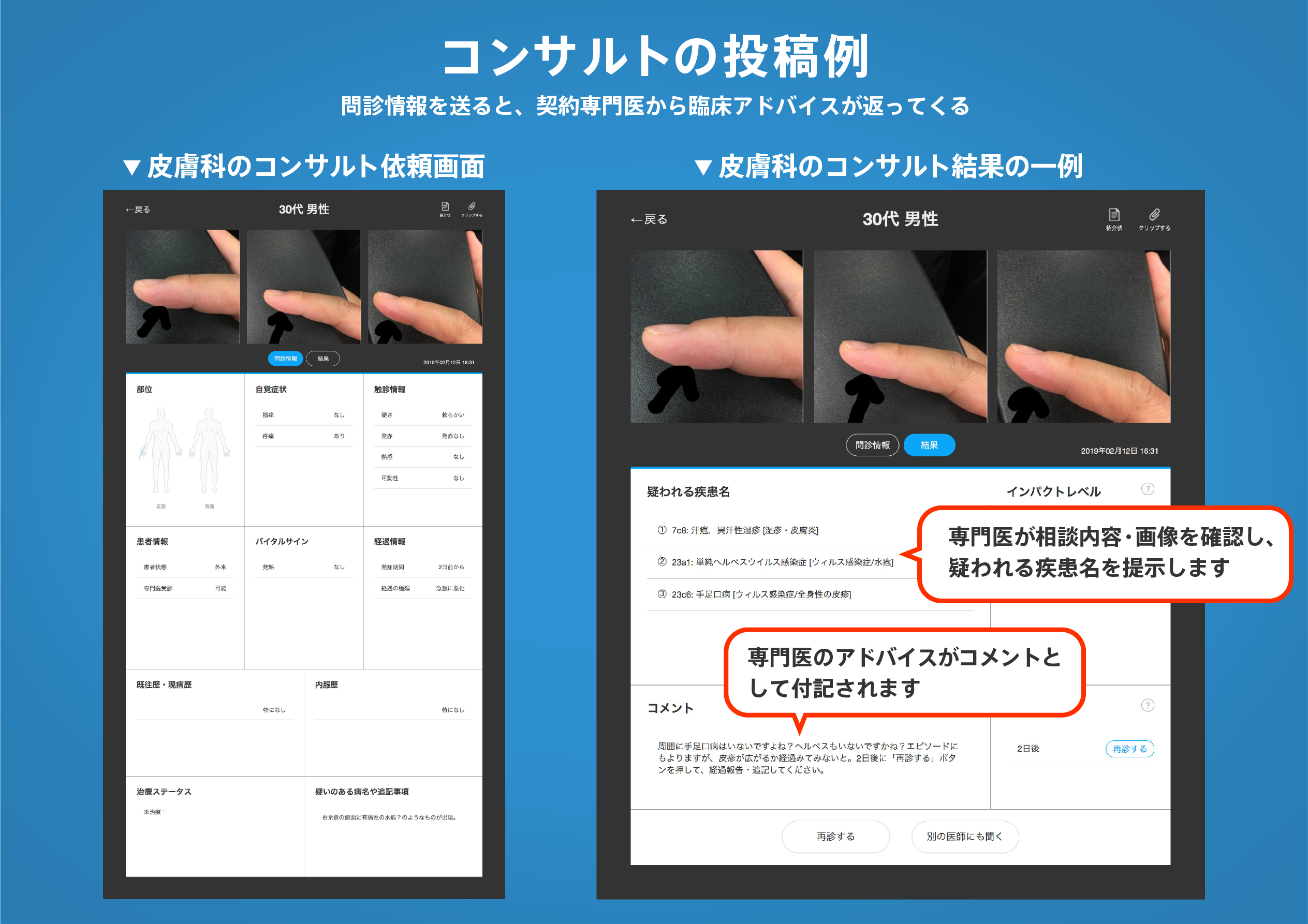

医師のための臨床サポートサービス

ヒポクラ x マイナビのご紹介

無料会員登録していただくと、さらに便利で効率的な検索が可能になります。