著名医師による解説が無料で読めます

すると翻訳の精度が向上します

目的:ディープラーニングは、医療画像分類タスクを改善するための大きな可能性を示しています。ただし、ディープラーニングシステムが使用する画像のどの側面を使用するか、または話す方法で、その予測を行うことは困難です。 材料と方法:放射線学的なイメージングのコンテキスト内で、深い学習が活性化する画像内の機能を識別するように設計された方法の有用性を調査しました。この研究では、全スライスCTデータからコントラスト増強段階を特定する分類器を開発しました。次に、この分類器を簡単に解釈できるシステムとして使用して、クラスアクティベーションマップ(CAM)、グラデーション加重クラスアクティベーションマップ(グレードカム)、顕著性マップ、ガイド付きバックプロパゲーションマップ、および顕著性活性化マップのユーティリティを調査しました。ここで報告されているのは、予測を実行するときに使用されるモデルが画像機能を識別するためです。 結果:すべての手法では、分類器が使用したイメージング内のボクセルが識別されました。SAMSは、モデルが予測を実行するために使用したイメージング内のボクセルを識別する際に、ガイド付きバックプロパゲーションマップ、CAM、およびGrad-CAMよりも優れた特異性を持っていました。浅いネットワークレイヤーでは、SAMSは、モデル内のレイヤーが予測を実行するために使用した入力ボクセルを識別する上で、Grad-Camsよりも優れた特異性を持っていました。 結論:全体として、浅いネットワークレイヤーをアクティブ化するイメージング機能のボクセルレベルの視覚化と視覚化は、深い学習モデルが予測を実行するときに使用する機能を特定する強力な手法です。

目的:ディープラーニングは、医療画像分類タスクを改善するための大きな可能性を示しています。ただし、ディープラーニングシステムが使用する画像のどの側面を使用するか、または話す方法で、その予測を行うことは困難です。 材料と方法:放射線学的なイメージングのコンテキスト内で、深い学習が活性化する画像内の機能を識別するように設計された方法の有用性を調査しました。この研究では、全スライスCTデータからコントラスト増強段階を特定する分類器を開発しました。次に、この分類器を簡単に解釈できるシステムとして使用して、クラスアクティベーションマップ(CAM)、グラデーション加重クラスアクティベーションマップ(グレードカム)、顕著性マップ、ガイド付きバックプロパゲーションマップ、および顕著性活性化マップのユーティリティを調査しました。ここで報告されているのは、予測を実行するときに使用されるモデルが画像機能を識別するためです。 結果:すべての手法では、分類器が使用したイメージング内のボクセルが識別されました。SAMSは、モデルが予測を実行するために使用したイメージング内のボクセルを識別する際に、ガイド付きバックプロパゲーションマップ、CAM、およびGrad-CAMよりも優れた特異性を持っていました。浅いネットワークレイヤーでは、SAMSは、モデル内のレイヤーが予測を実行するために使用した入力ボクセルを識別する上で、Grad-Camsよりも優れた特異性を持っていました。 結論:全体として、浅いネットワークレイヤーをアクティブ化するイメージング機能のボクセルレベルの視覚化と視覚化は、深い学習モデルが予測を実行するときに使用する機能を特定する強力な手法です。

OBJECTIVE: Deep learning has shown great promise for improving medical image classification tasks. However, knowing what aspects of an image the deep learning system uses or, in a manner of speaking, sees to make its prediction is difficult. MATERIALS AND METHODS: Within a radiologic imaging context, we investigated the utility of methods designed to identify features within images on which deep learning activates. In this study, we developed a classifier to identify contrast enhancement phase from whole-slice CT data. We then used this classifier as an easily interpretable system to explore the utility of class activation map (CAMs), gradient-weighted class activation maps (Grad-CAMs), saliency maps, guided backpropagation maps, and the saliency activation map, a novel map reported here, to identify image features the model used when performing prediction. RESULTS: All techniques identified voxels within imaging that the classifier used. SAMs had greater specificity than did guided backpropagation maps, CAMs, and Grad-CAMs at identifying voxels within imaging that the model used to perform prediction. At shallow network layers, SAMs had greater specificity than Grad-CAMs at identifying input voxels that the layers within the model used to perform prediction. CONCLUSION: As a whole, voxel-level visualizations and visualizations of the imaging features that activate shallow network layers are powerful techniques to identify features that deep learning models use when performing prediction.

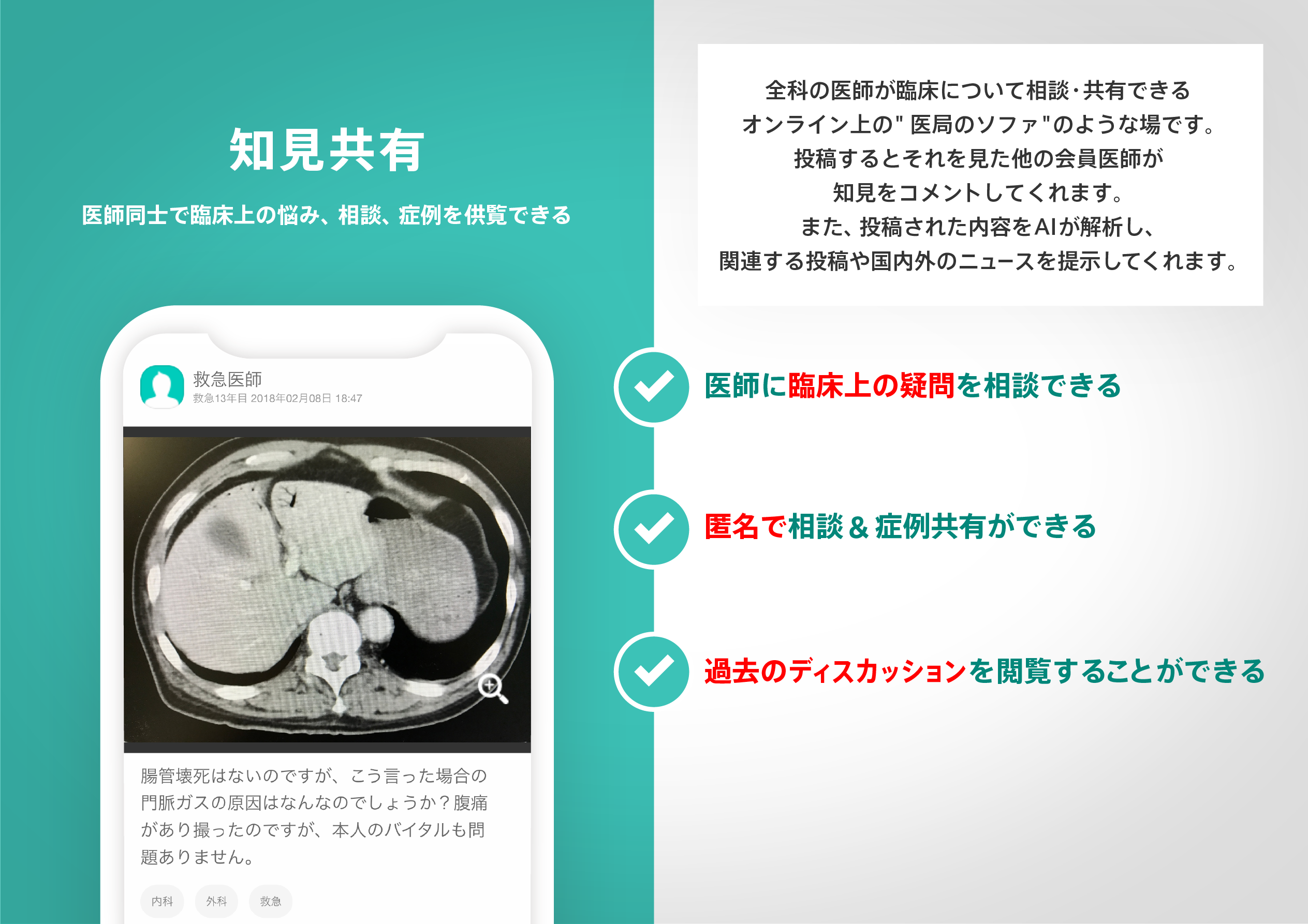

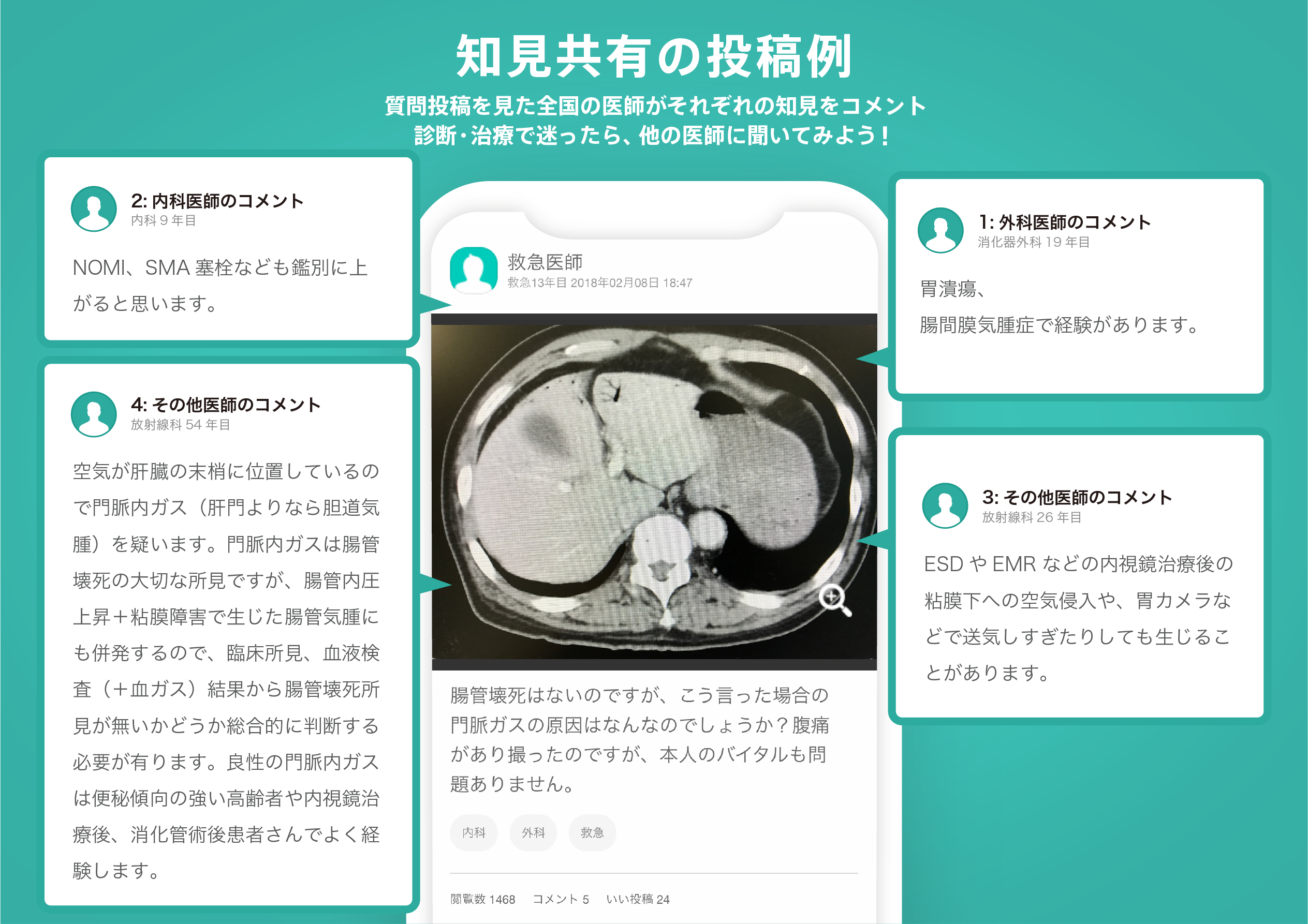

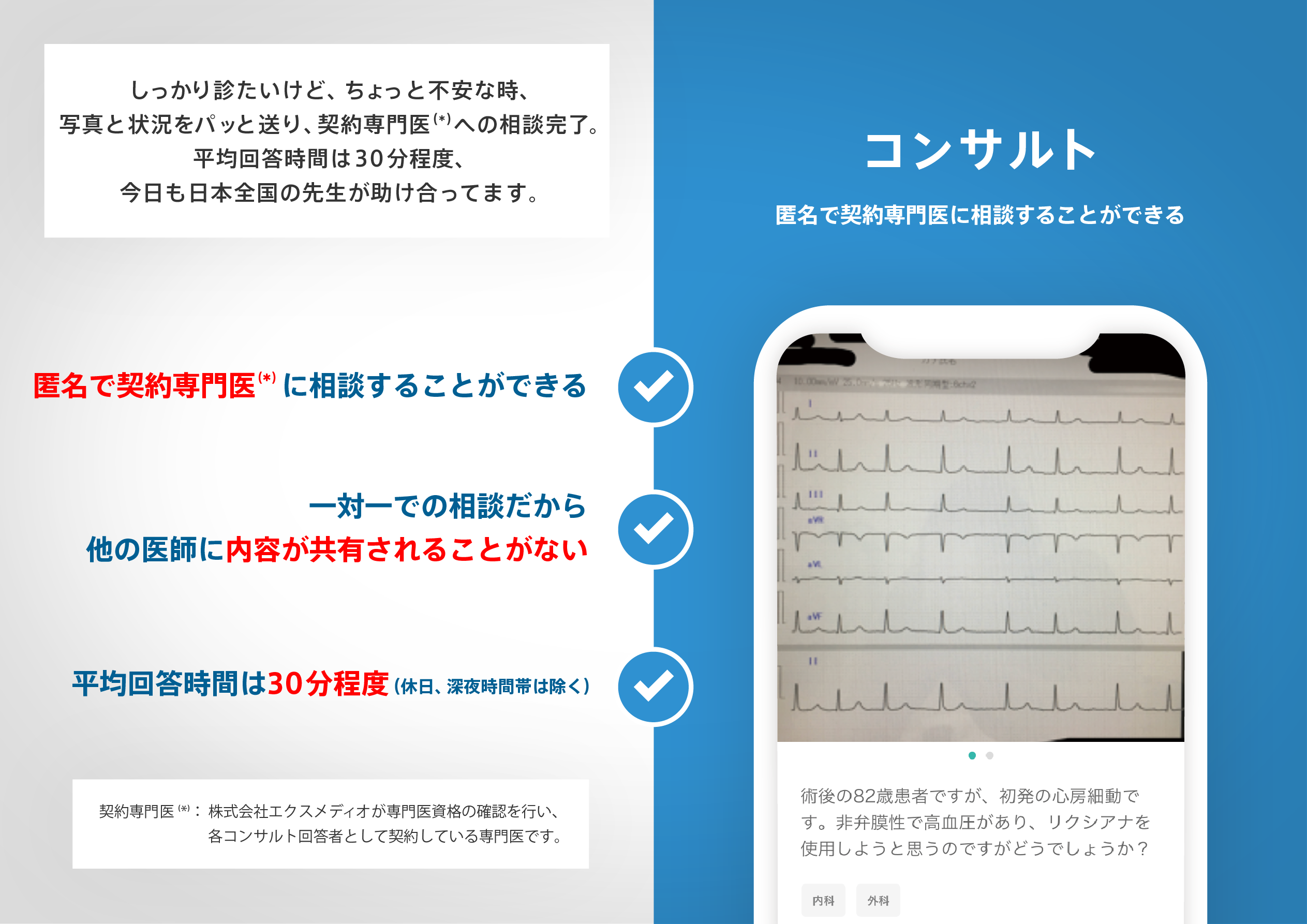

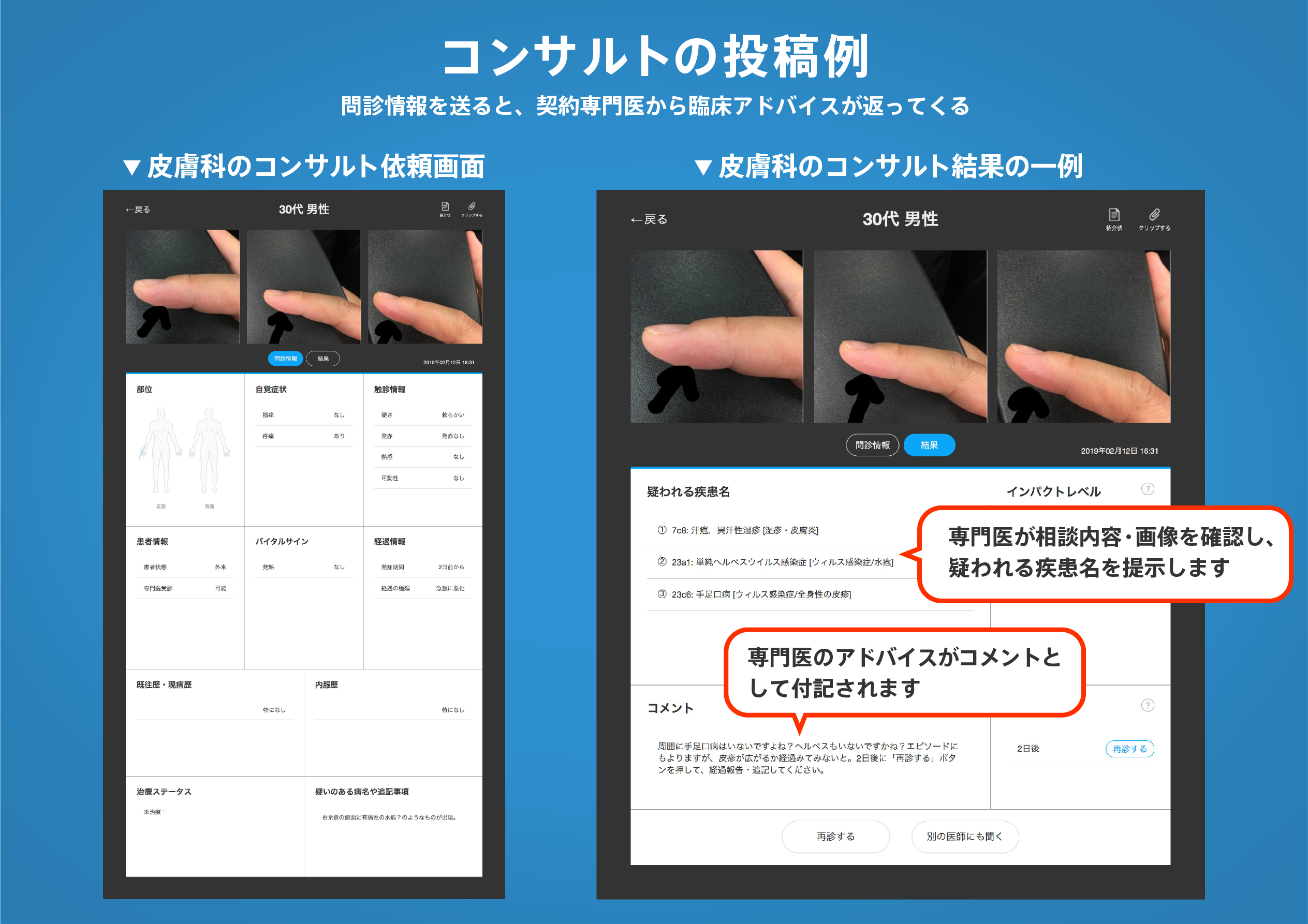

医師のための臨床サポートサービス

ヒポクラ x マイナビのご紹介

無料会員登録していただくと、さらに便利で効率的な検索が可能になります。