著名医師による解説が無料で読めます

すると翻訳の精度が向上します

現実世界の機械学習アプリケーションでは、データサブセットは特に重要な結果に対応しています。脆弱なサイクリスト検出は、自律的な運転タスクでは安全性があり、「質問」文は、製品の目的での対話エージェントの言語理解にとって重要かもしれません。機械学習モデルは、F1スコアや全体的な精度などの粗粒メトリックで高品質のパフォーマンスを達成できますが、重要なサブセットでパフォーマンスを下回る可能性があります。これらをスライスとして定義し、アプローチの重要な抽象化です。スライスレベルのパフォーマンスに対処するために、開業医はしばしばスライスサブセットで個別の「エキスパート」モデルをトレーニングするか、マルチタスクハードパラメーター共有を使用します。プログラミングインターフェイスであるスライス関数(SF)が、モデルが追加の容量をコミットする重要なデータサブセットを指定する新しいプログラミングモデルであるスライスベースの学習を提案します。どのモデルもSFSを活用して、スライスの専門家表現を学習できます。これは、注意メカニズムと組み合わせてスライスを認識する予測を行います。私たちのアプローチは、言語の理解(スーパーグルーなど)、コンピュータービジョン、および生産規模の産業システムにまたがるデータセットで最大19.0 F1、データセットで4.6 F1だけでベースラインを改善しながら、パラメーター効率の高い表現を維持していることを示します。

現実世界の機械学習アプリケーションでは、データサブセットは特に重要な結果に対応しています。脆弱なサイクリスト検出は、自律的な運転タスクでは安全性があり、「質問」文は、製品の目的での対話エージェントの言語理解にとって重要かもしれません。機械学習モデルは、F1スコアや全体的な精度などの粗粒メトリックで高品質のパフォーマンスを達成できますが、重要なサブセットでパフォーマンスを下回る可能性があります。これらをスライスとして定義し、アプローチの重要な抽象化です。スライスレベルのパフォーマンスに対処するために、開業医はしばしばスライスサブセットで個別の「エキスパート」モデルをトレーニングするか、マルチタスクハードパラメーター共有を使用します。プログラミングインターフェイスであるスライス関数(SF)が、モデルが追加の容量をコミットする重要なデータサブセットを指定する新しいプログラミングモデルであるスライスベースの学習を提案します。どのモデルもSFSを活用して、スライスの専門家表現を学習できます。これは、注意メカニズムと組み合わせてスライスを認識する予測を行います。私たちのアプローチは、言語の理解(スーパーグルーなど)、コンピュータービジョン、および生産規模の産業システムにまたがるデータセットで最大19.0 F1、データセットで4.6 F1だけでベースラインを改善しながら、パラメーター効率の高い表現を維持していることを示します。

In real-world machine learning applications, data subsets correspond to especially critical outcomes: vulnerable cyclist detections are safety-critical in an autonomous driving task, and "question" sentences might be important to a dialogue agent's language understanding for product purposes. While machine learning models can achieve high quality performance on coarse-grained metrics like F1-score and overall accuracy, they may underperform on critical subsets-we define these as slices, the key abstraction in our approach. To address slice-level performance, practitioners often train separate "expert" models on slice subsets or use multi-task hard parameter sharing. We propose Slice-based Learning, a new programming model in which the slicing function (SF), a programming interface, specifies critical data subsets for which the model should commit additional capacity. Any model can leverage SFs to learn slice expert representations, which are combined with an attention mechanism to make slice-aware predictions. We show that our approach maintains a parameter-efficient representation while improving over baselines by up to 19.0 F1 on slices and 4.6 F1 overall on datasets spanning language understanding (e.g. SuperGLUE), computer vision, and production-scale industrial systems.

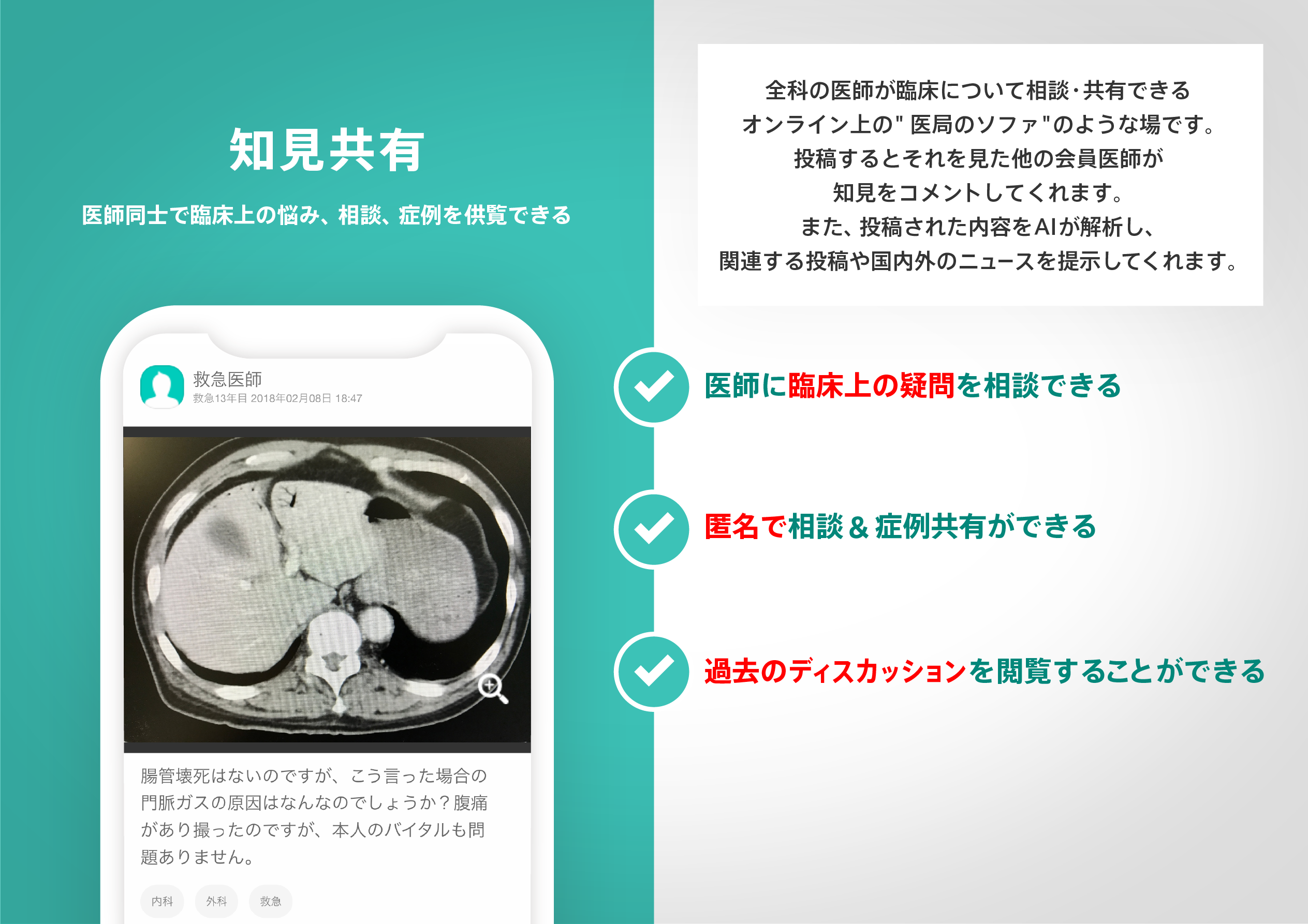

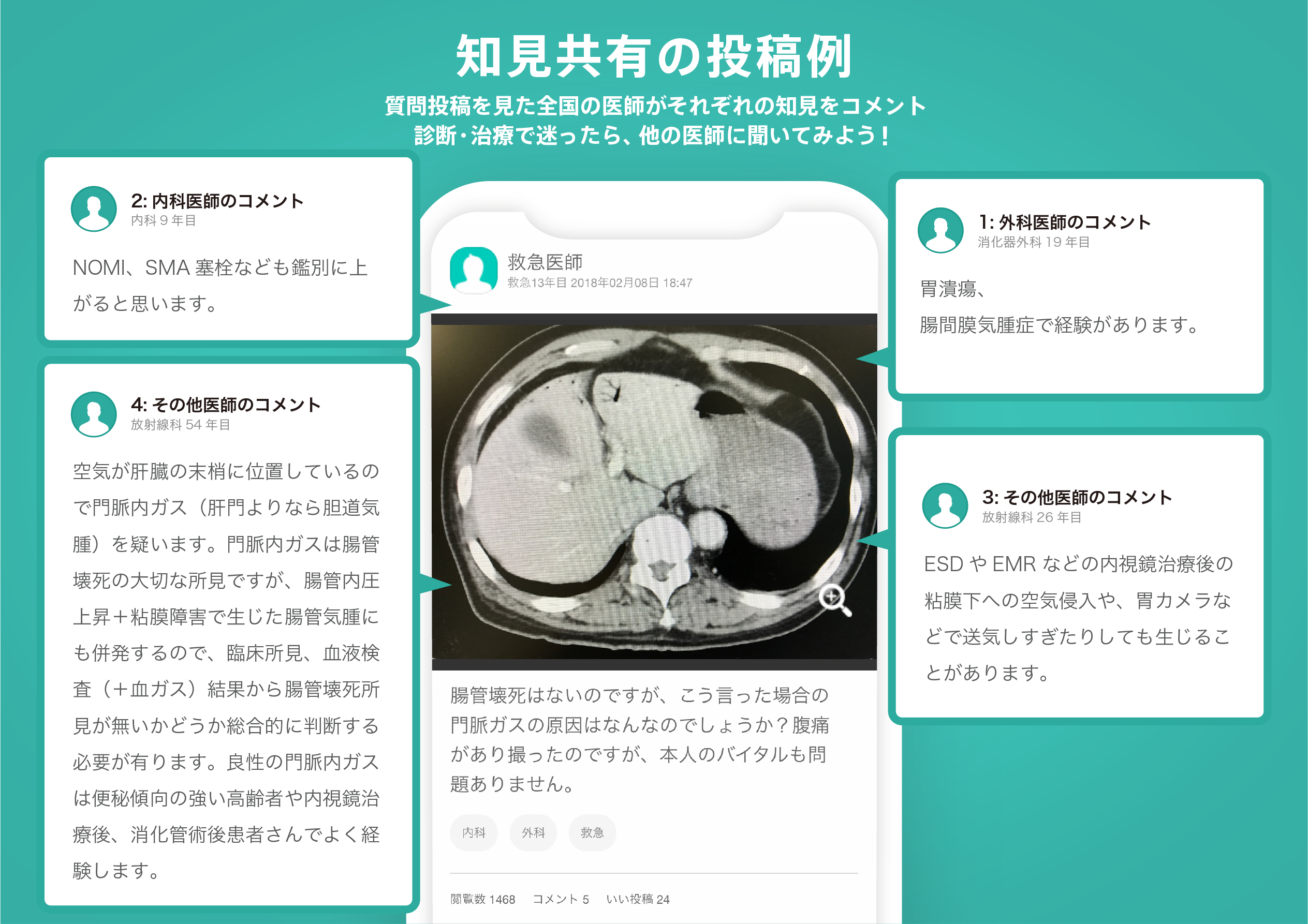

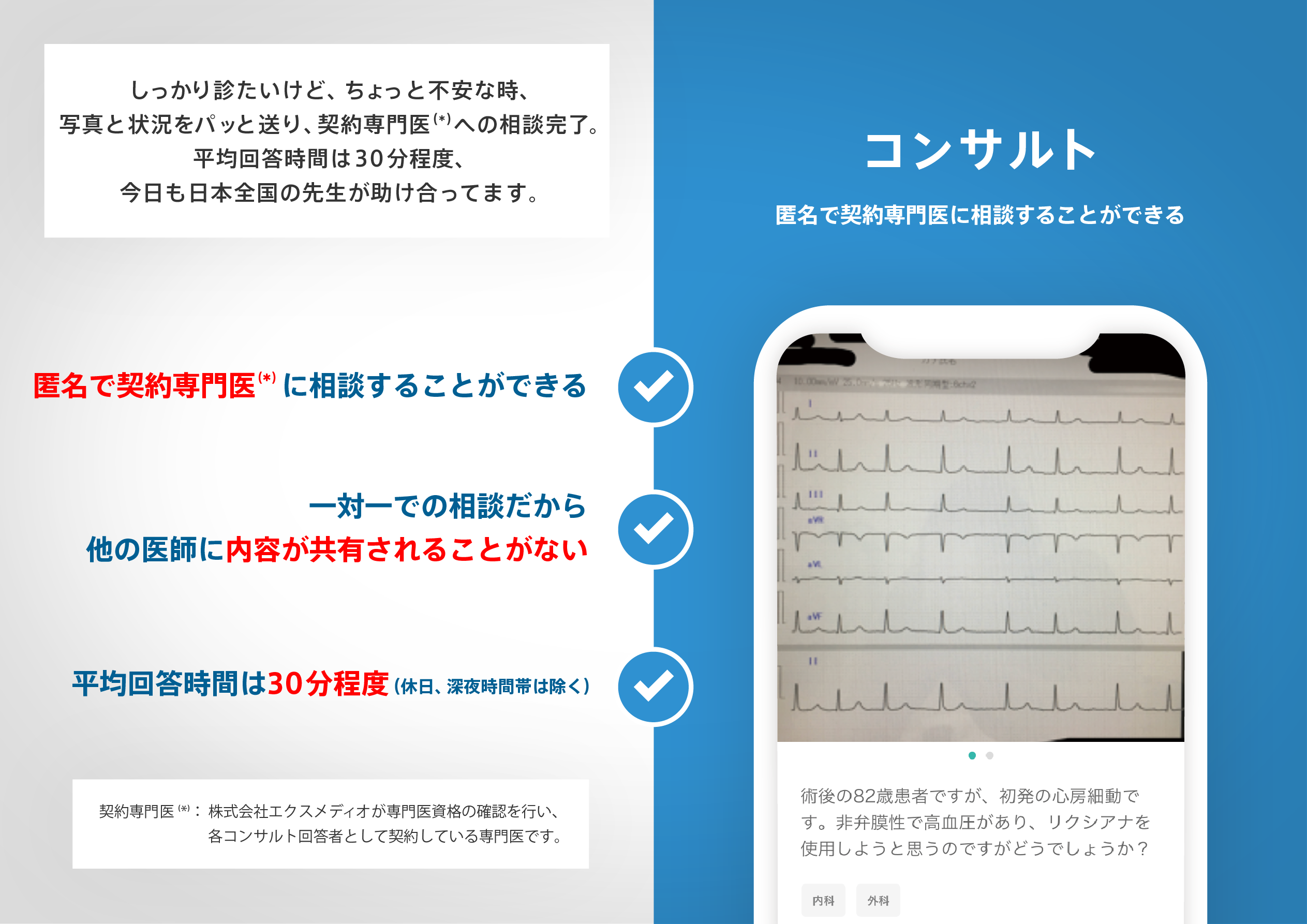

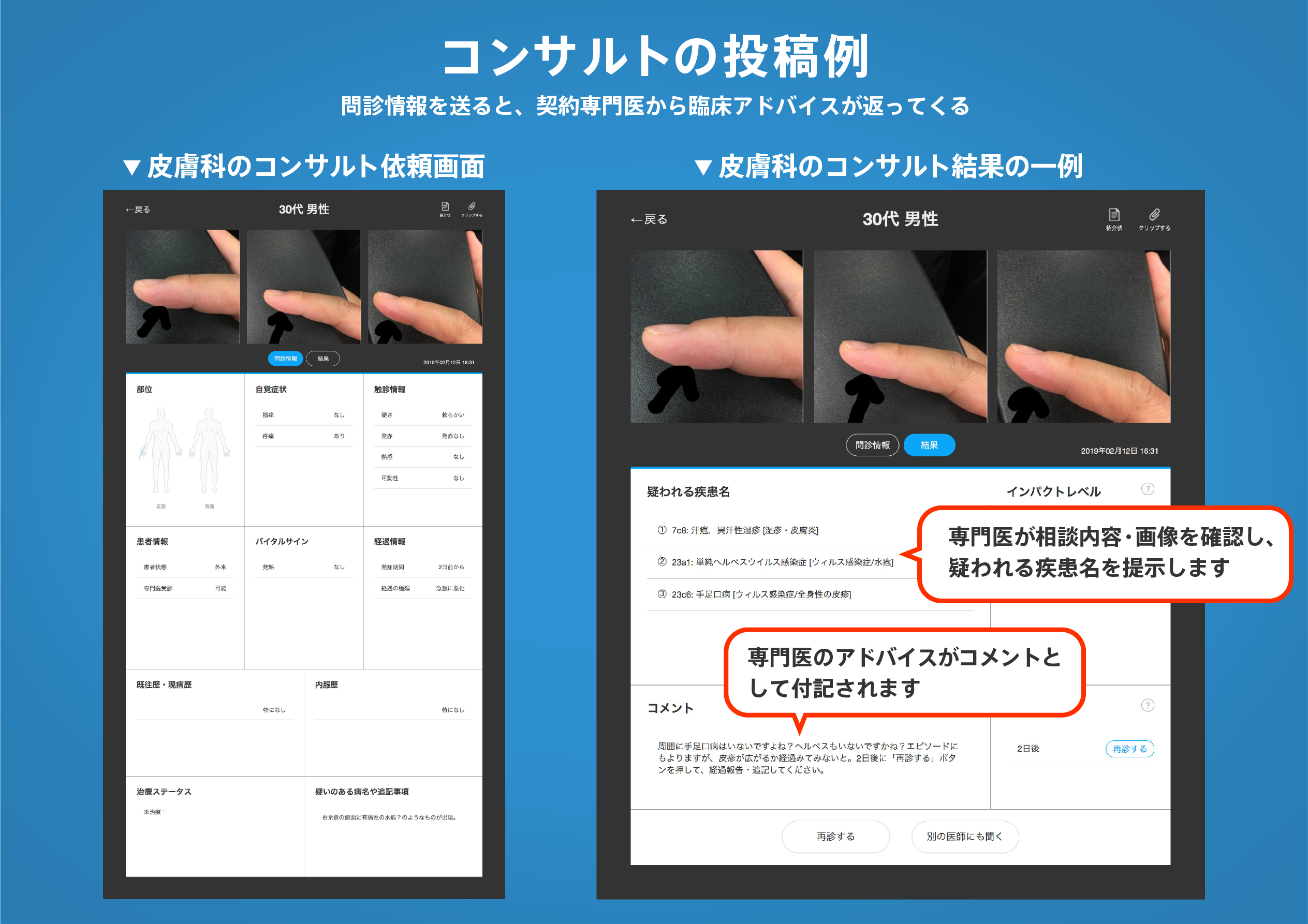

医師のための臨床サポートサービス

ヒポクラ x マイナビのご紹介

無料会員登録していただくと、さらに便利で効率的な検索が可能になります。