著名医師による解説が無料で読めます

すると翻訳の精度が向上します

背景:バイオインフォマティクスにおける深い学習アルゴリズムのアプリケーションの数は、通常、より大きなトレーニングデータセットが利用可能な場合、古典的なアプローチよりも優れたパフォーマンスを達成するため、増加しています。ディープラーニングアプリケーションでは、個別のデータ、例えば言語の単語またはnグラム、またはバイオインフォマティクスのアミノ酸またはヌクレオチドは、一般に埋め込みマトリックスを介して連続ベクターとして表されます。最近、ターゲット予測(「エンドツーエンド学習」と呼ばれるプロセス)を最適化するために、モデルの連続的な反復の一部としてデータからこの埋め込みマトリックスを直接学習することは、多くの結果につながりました。フィールド。埋め込みの使用は、バイオインフォマティクスの文献でよく説明されていますが、より古典的な手動で測定されたエンコーディング戦略と比較して、単一アミノ酸のエンドツーエンド学習の可能性は体系的に対処されていません。この目的のために、3つの広く使用されているアーキテクチャを使用した2つの異なる予測タスクのアミノ酸埋め込みの1つのホット、VHSE8およびBlosum62、すなわち、1つのホット、VHSE8およびBlosum62の古典的なエンコーディングマトリックスを比較しました。ニューラルネットワーク(CNN)、およびハイブリッドCNN-RNN。 結果:さまざまなディープラーニングアーキテクチャを使用することにより、エンドツーエンドの学習が、限られたトレーニングデータが利用可能であっても、同じ次元の埋め込みのための古典的なエンコーディングと同等であり、パフォーマンスなしで埋め込みディメンションを減らすことができる場合があることを示します。損失は、計算能力が限られているデバイスにモデルを展開する場合に重要です。埋め込みディメンションがモデルのパフォーマンスを制御する主要な要因であることがわかりました。驚くべきことに、深い学習モデルは、適切な次元のランダムベクターから学習できることを観察しました。 結論:私たちの研究は、エンドツーエンドの学習がアミノ酸エンコーディングの柔軟で強力な方法であることを示しています。さらに、ディープラーニングシステムの柔軟性により、アミノ酸をコードするスキームは、同じ次元のランダムベクターに対してベンチマークされて、スキームによって提供される識別性効果からエンコードスキームによって提供される情報コンテンツを解く必要があります。

背景:バイオインフォマティクスにおける深い学習アルゴリズムのアプリケーションの数は、通常、より大きなトレーニングデータセットが利用可能な場合、古典的なアプローチよりも優れたパフォーマンスを達成するため、増加しています。ディープラーニングアプリケーションでは、個別のデータ、例えば言語の単語またはnグラム、またはバイオインフォマティクスのアミノ酸またはヌクレオチドは、一般に埋め込みマトリックスを介して連続ベクターとして表されます。最近、ターゲット予測(「エンドツーエンド学習」と呼ばれるプロセス)を最適化するために、モデルの連続的な反復の一部としてデータからこの埋め込みマトリックスを直接学習することは、多くの結果につながりました。フィールド。埋め込みの使用は、バイオインフォマティクスの文献でよく説明されていますが、より古典的な手動で測定されたエンコーディング戦略と比較して、単一アミノ酸のエンドツーエンド学習の可能性は体系的に対処されていません。この目的のために、3つの広く使用されているアーキテクチャを使用した2つの異なる予測タスクのアミノ酸埋め込みの1つのホット、VHSE8およびBlosum62、すなわち、1つのホット、VHSE8およびBlosum62の古典的なエンコーディングマトリックスを比較しました。ニューラルネットワーク(CNN)、およびハイブリッドCNN-RNN。 結果:さまざまなディープラーニングアーキテクチャを使用することにより、エンドツーエンドの学習が、限られたトレーニングデータが利用可能であっても、同じ次元の埋め込みのための古典的なエンコーディングと同等であり、パフォーマンスなしで埋め込みディメンションを減らすことができる場合があることを示します。損失は、計算能力が限られているデバイスにモデルを展開する場合に重要です。埋め込みディメンションがモデルのパフォーマンスを制御する主要な要因であることがわかりました。驚くべきことに、深い学習モデルは、適切な次元のランダムベクターから学習できることを観察しました。 結論:私たちの研究は、エンドツーエンドの学習がアミノ酸エンコーディングの柔軟で強力な方法であることを示しています。さらに、ディープラーニングシステムの柔軟性により、アミノ酸をコードするスキームは、同じ次元のランダムベクターに対してベンチマークされて、スキームによって提供される識別性効果からエンコードスキームによって提供される情報コンテンツを解く必要があります。

BACKGROUND: The number of applications of deep learning algorithms in bioinformatics is increasing as they usually achieve superior performance over classical approaches, especially, when bigger training datasets are available. In deep learning applications, discrete data, e.g. words or n-grams in language, or amino acids or nucleotides in bioinformatics, are generally represented as a continuous vector through an embedding matrix. Recently, learning this embedding matrix directly from the data as part of the continuous iteration of the model to optimize the target prediction - a process called 'end-to-end learning' - has led to state-of-the-art results in many fields. Although usage of embeddings is well described in the bioinformatics literature, the potential of end-to-end learning for single amino acids, as compared to more classical manually-curated encoding strategies, has not been systematically addressed. To this end, we compared classical encoding matrices, namely one-hot, VHSE8 and BLOSUM62, to end-to-end learning of amino acid embeddings for two different prediction tasks using three widely used architectures, namely recurrent neural networks (RNN), convolutional neural networks (CNN), and the hybrid CNN-RNN. RESULTS: By using different deep learning architectures, we show that end-to-end learning is on par with classical encodings for embeddings of the same dimension even when limited training data is available, and might allow for a reduction in the embedding dimension without performance loss, which is critical when deploying the models to devices with limited computational capacities. We found that the embedding dimension is a major factor in controlling the model performance. Surprisingly, we observed that deep learning models are capable of learning from random vectors of appropriate dimension. CONCLUSION: Our study shows that end-to-end learning is a flexible and powerful method for amino acid encoding. Further, due to the flexibility of deep learning systems, amino acid encoding schemes should be benchmarked against random vectors of the same dimension to disentangle the information content provided by the encoding scheme from the distinguishability effect provided by the scheme.

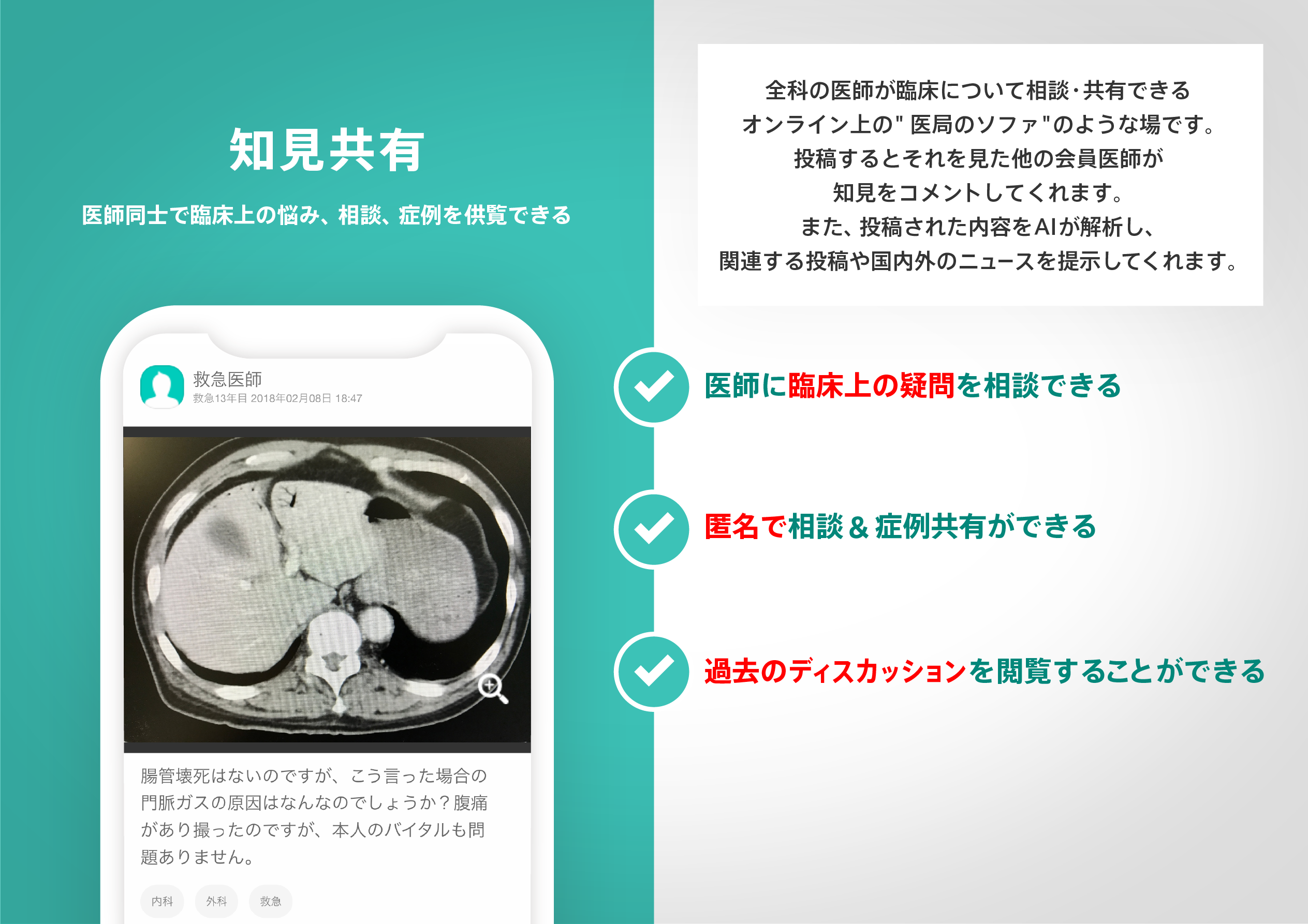

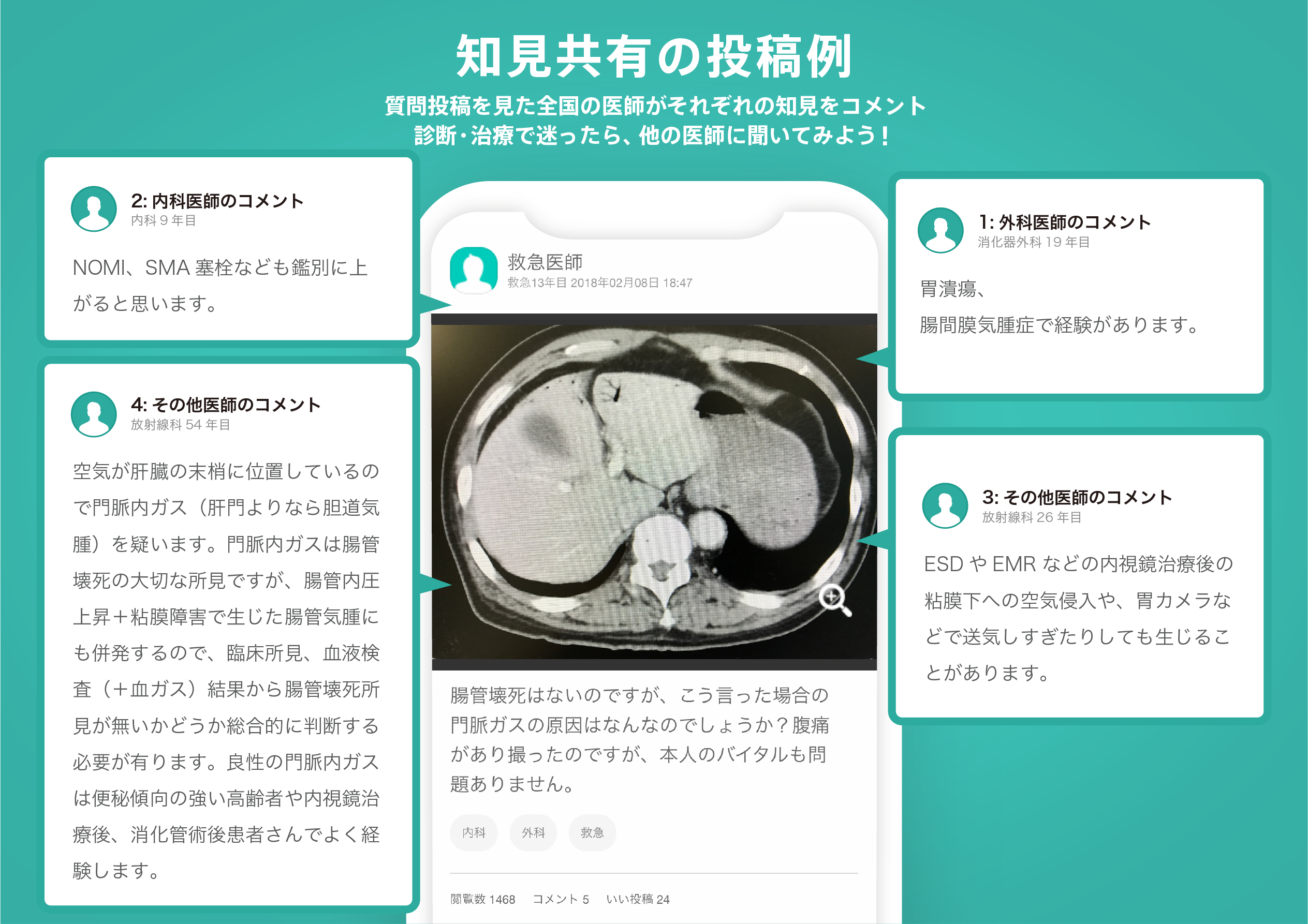

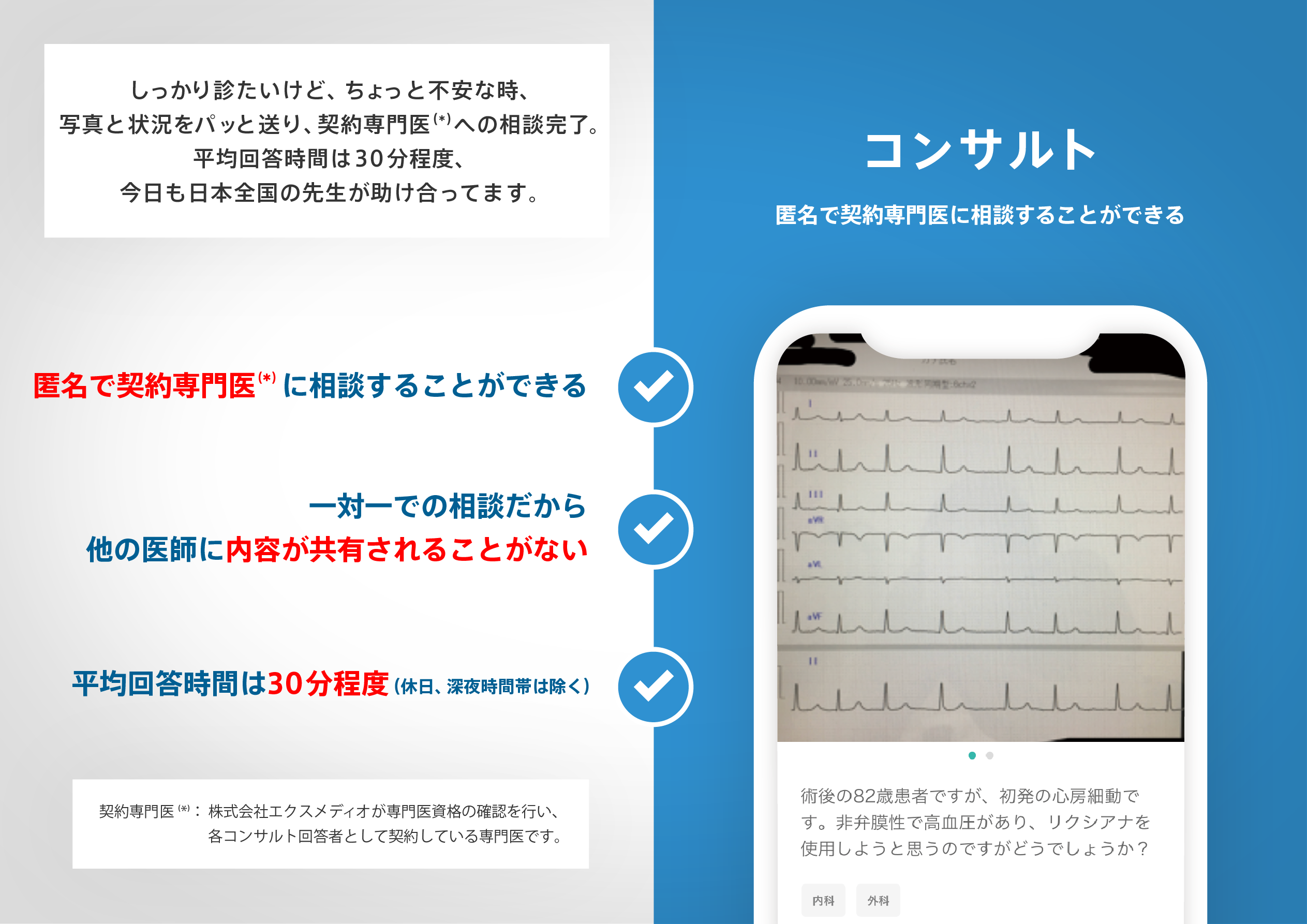

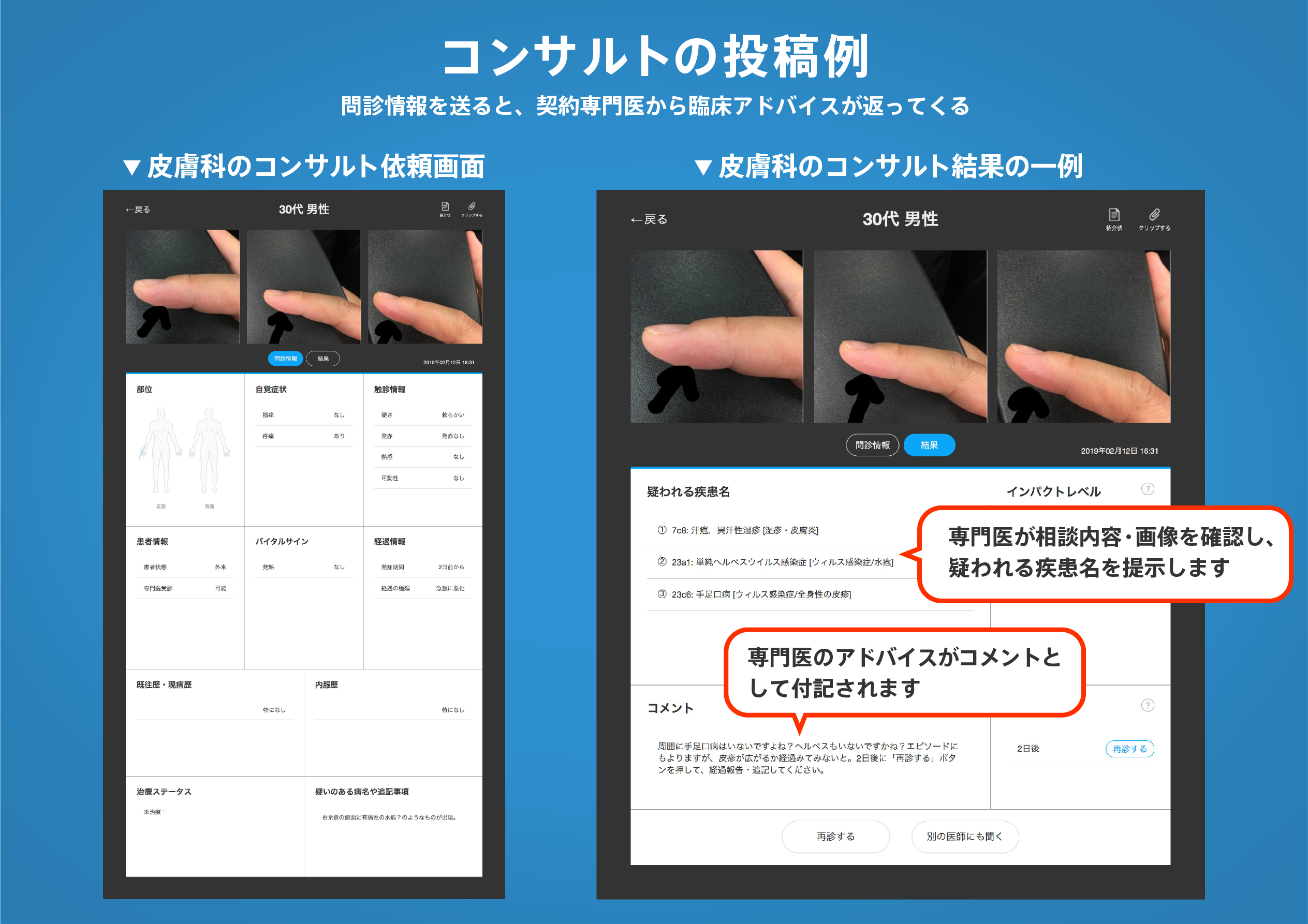

医師のための臨床サポートサービス

ヒポクラ x マイナビのご紹介

無料会員登録していただくと、さらに便利で効率的な検索が可能になります。