著名医師による解説が無料で読めます

すると翻訳の精度が向上します

ローカル画像機能マッチングの新しい方法を提示します。画像機能の検出、説明、および順次マッチングを実行する代わりに、最初に粗いレベルでピクセルごとの密な一致を確立し、後で良いレベルで良い一致を改良することを提案します。コストボリュームを使用するためにコストボリュームを使用する密な方法とは対照的に、変圧器の自己および注意層を使用して、両方の画像に条件付けられた特徴記述子を取得します。Transformerが提供するグローバル受容フィールドにより、当社の方法は、機能検出器が通常、再現性のある関心ポイントを作成するのに苦労している低テクスチャーエリアで密な一致を生成することができます。屋内および屋外のデータセットでの実験は、LOFTRが大きなマージンで最先端の方法よりも優れていることを示しています。さらに、LOFTRを最新のSFMシステムに適応させ、そのアプリケーションを複数ビュージオメトリに示します。提案された方法は、画像マッチングチャレンジ2021で優れたパフォーマンスを示し、公開された方法の間で視覚的ローカリゼーションの2つのパブリックベンチマークで最初にランク付けされます。このコードは、https://zju3dv.github.io/loftrで入手できます。

ローカル画像機能マッチングの新しい方法を提示します。画像機能の検出、説明、および順次マッチングを実行する代わりに、最初に粗いレベルでピクセルごとの密な一致を確立し、後で良いレベルで良い一致を改良することを提案します。コストボリュームを使用するためにコストボリュームを使用する密な方法とは対照的に、変圧器の自己および注意層を使用して、両方の画像に条件付けられた特徴記述子を取得します。Transformerが提供するグローバル受容フィールドにより、当社の方法は、機能検出器が通常、再現性のある関心ポイントを作成するのに苦労している低テクスチャーエリアで密な一致を生成することができます。屋内および屋外のデータセットでの実験は、LOFTRが大きなマージンで最先端の方法よりも優れていることを示しています。さらに、LOFTRを最新のSFMシステムに適応させ、そのアプリケーションを複数ビュージオメトリに示します。提案された方法は、画像マッチングチャレンジ2021で優れたパフォーマンスを示し、公開された方法の間で視覚的ローカリゼーションの2つのパブリックベンチマークで最初にランク付けされます。このコードは、https://zju3dv.github.io/loftrで入手できます。

We present a novel method for local image feature matching. Instead of performing image feature detection, description, and matching sequentially, we propose to first establish pixel-wise dense matches at a coarse level and later refine the good matches at a fine level. In contrast to dense methods that use a cost volume to search correspondences, we use self and cross attention layers in Transformer to obtain feature descriptors that are conditioned on both images. The global receptive field provided by Transformer enables our method to produce dense matches in low-texture areas, where feature detectors usually struggle to produce repeatable interest points. The experiments on indoor and outdoor datasets show that LoFTR outperforms state-of-the-art methods by a large margin. We further adapt LoFTR to modern SfM systems and illustrate its application in multiple-view geometry. The proposed method demonstrates superior performance in Image Matching Challenge 2021 and ranks first on two public benchmarks of visual localization among the published methods. The code is available at https://zju3dv.github.io/loftr.

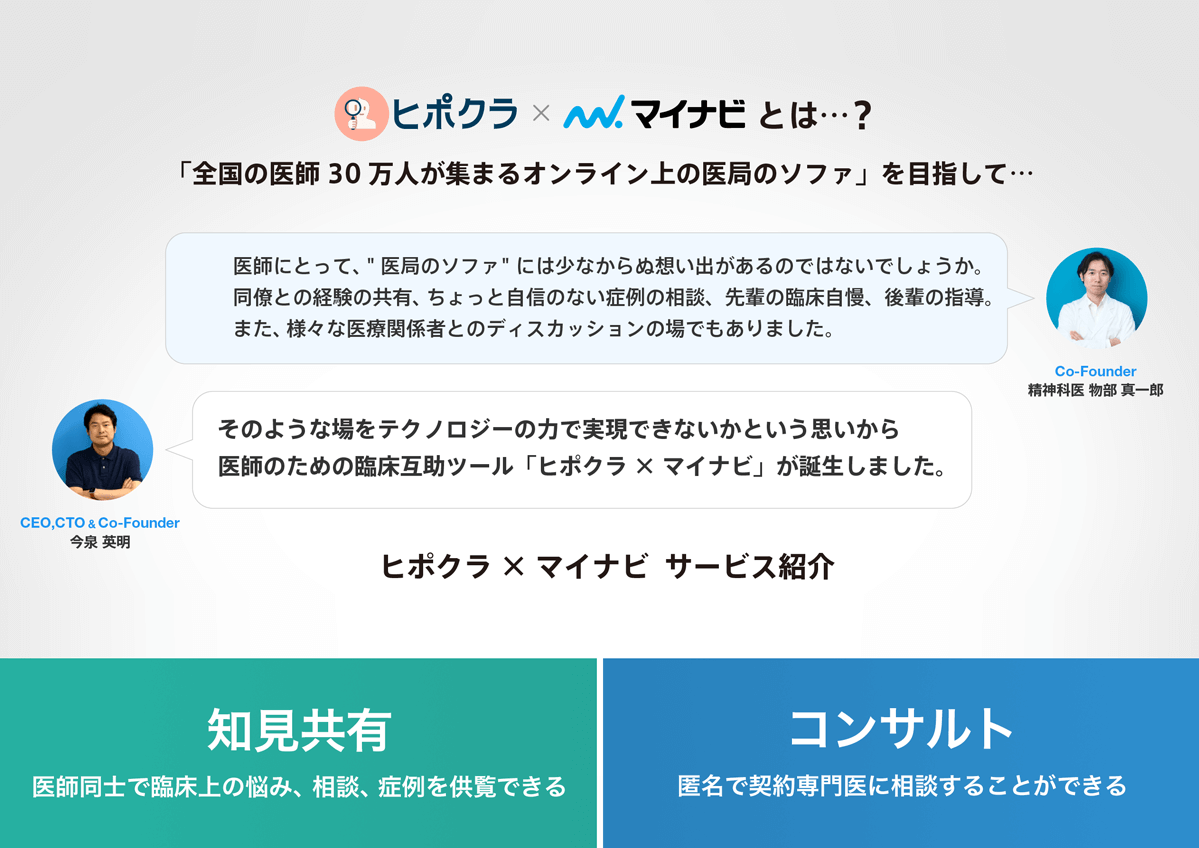

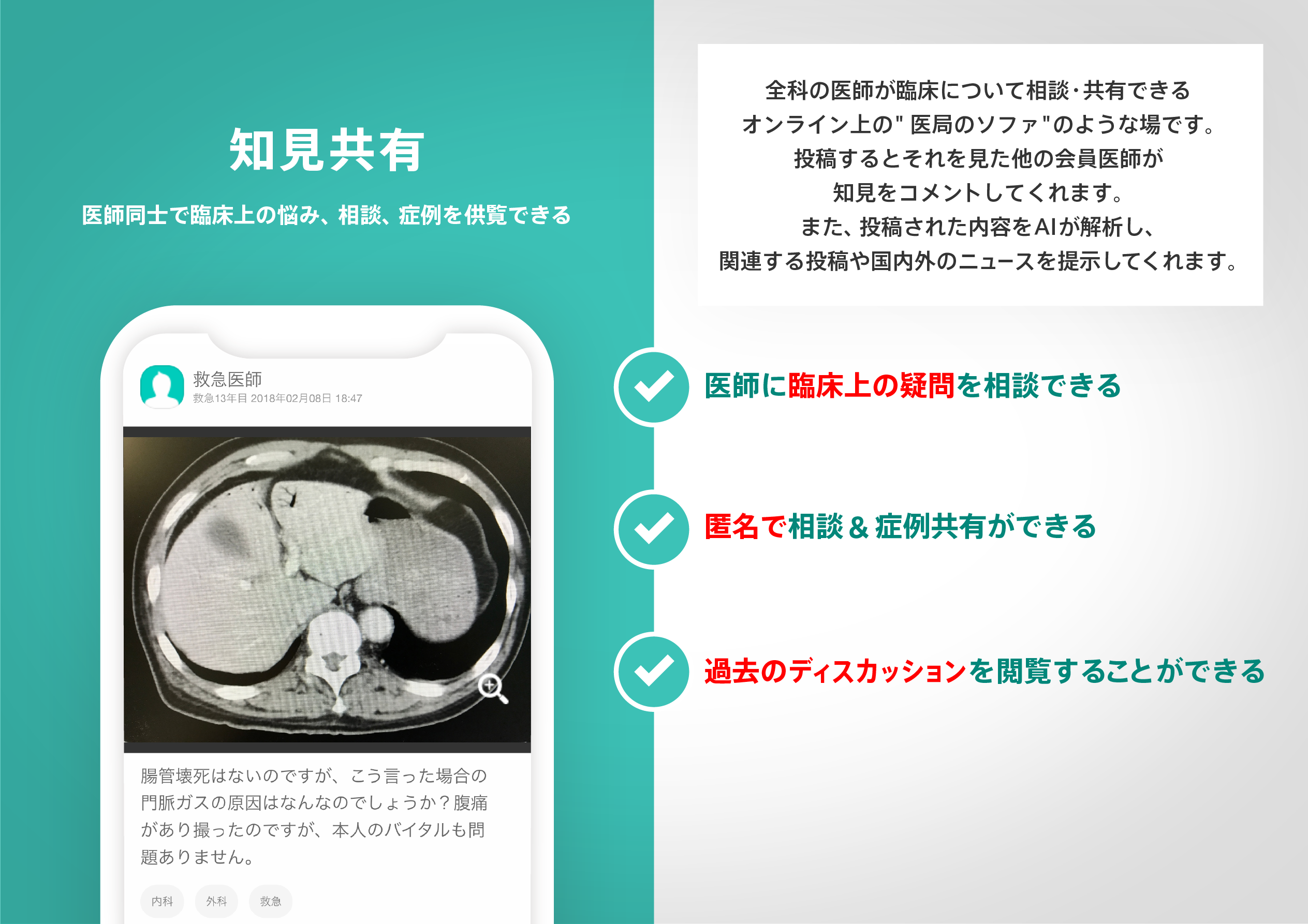

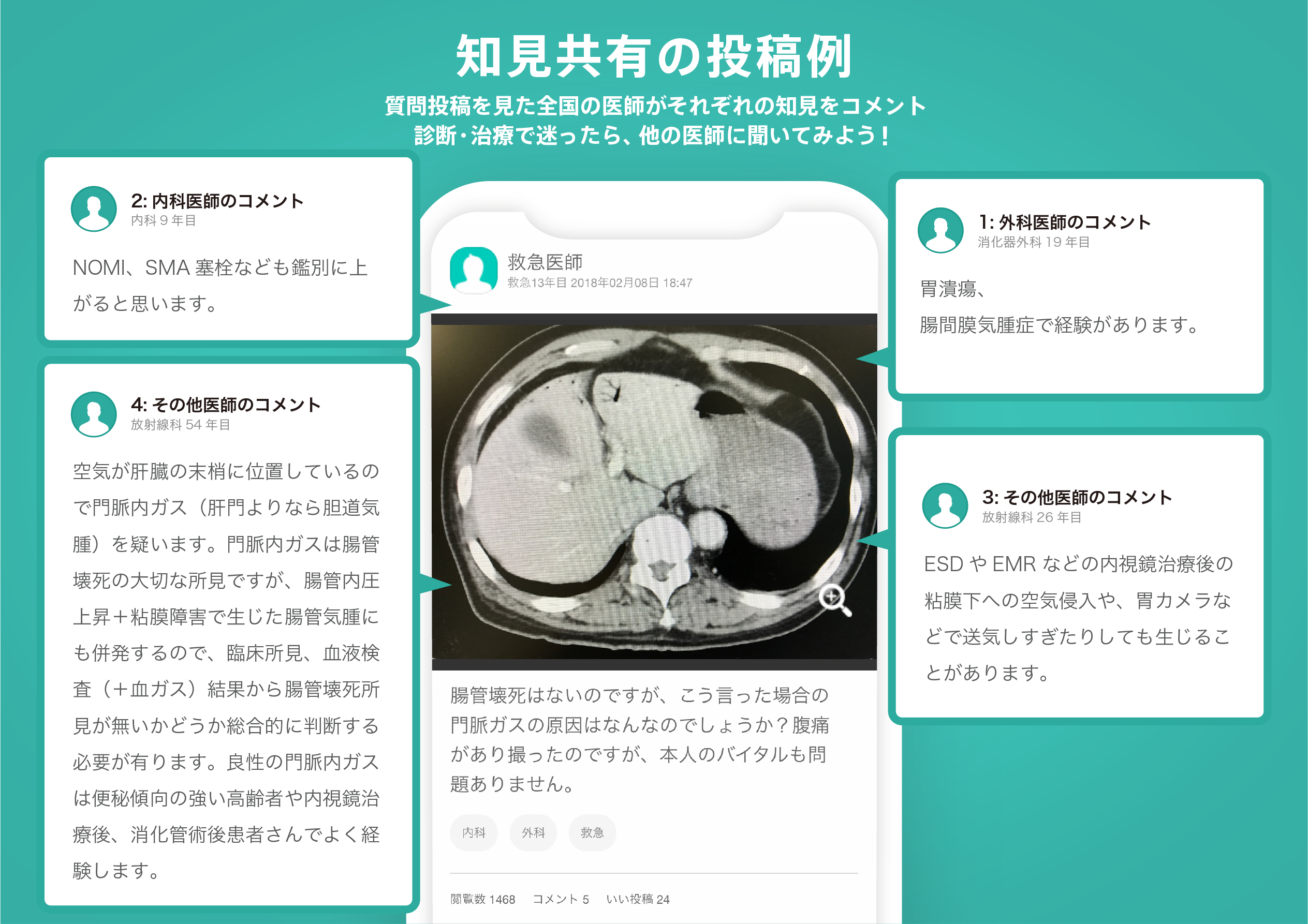

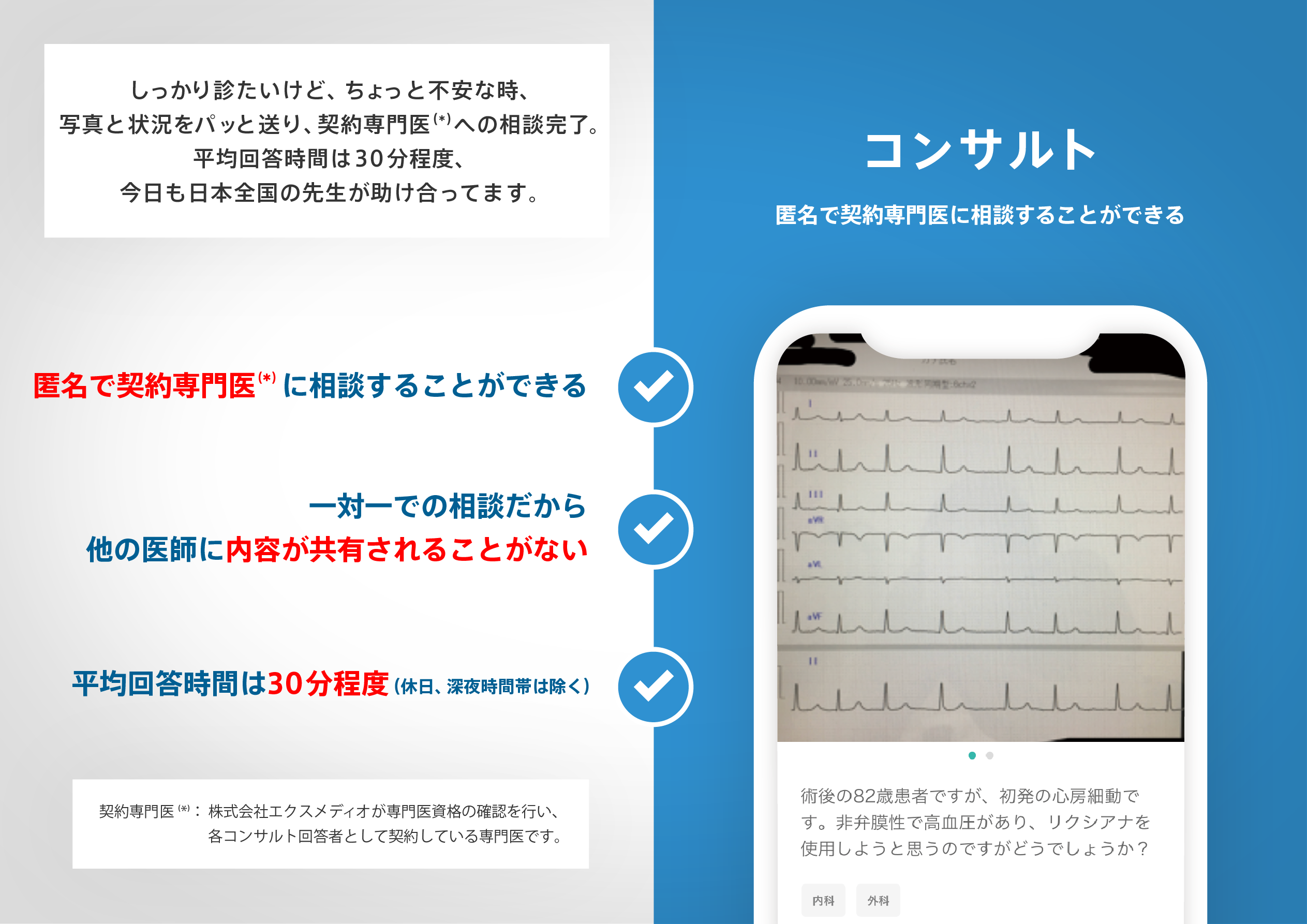

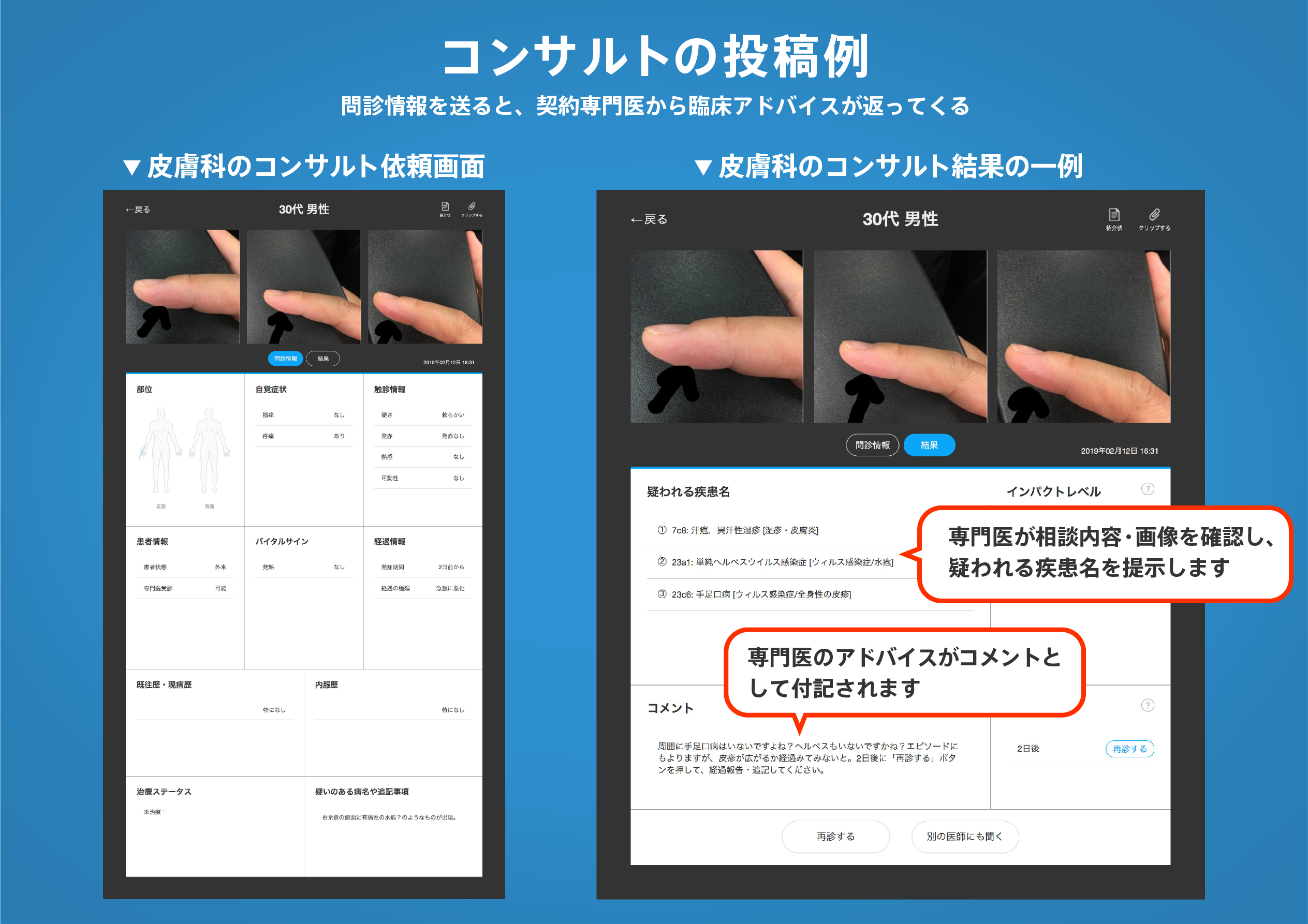

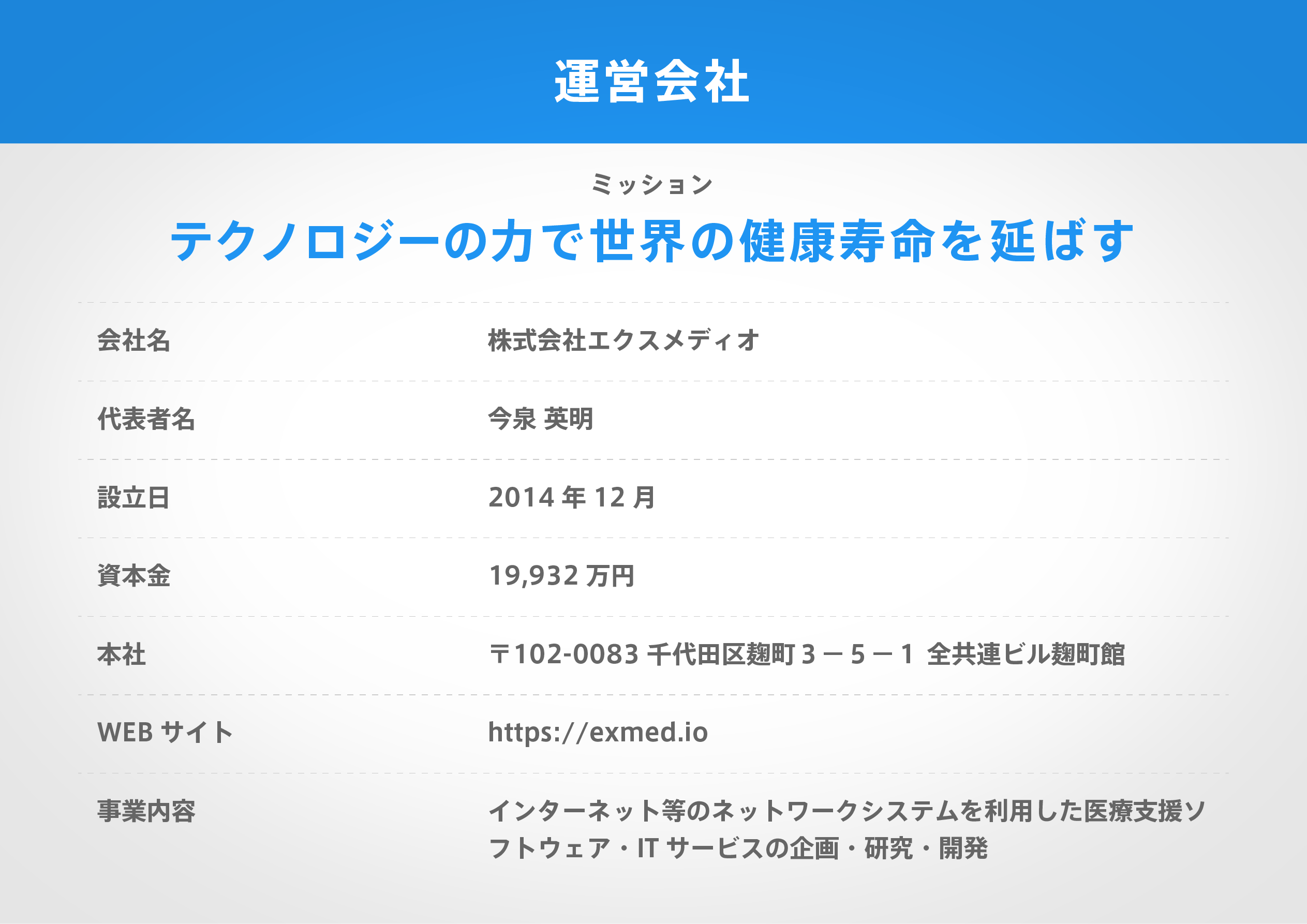

医師のための臨床サポートサービス

ヒポクラ x マイナビのご紹介

無料会員登録していただくと、さらに便利で効率的な検索が可能になります。