著名医師による解説が無料で読めます

すると翻訳の精度が向上します

背景:CHATGPTは、正しい単語を予測するために訓練された人工知能(AI)テキストジェネレーターであり、質問への回答を提供できますが、医学的な質問に答える際にさまざまな結果を示しています。 目的:CHATGPTの信頼性と正確性を評価するには、複雑な臨床的質問への回答を提供します。 方法:人口、介入、比較、結果、および時間(PICOT)フォーマットされた質問が照会され、参照のリクエストが尋ねられました。フルテキストの記事をレビューして、チャットボットが提供する証拠の概要の正確性を確認しました。 結果:ChatGptは、Picotの質問に証明可能な回答を提供できませんでした。証拠として引用された参考文献には、誤ったジャーナル情報が含まれており、CHATGPTによって要約された多くの研究の詳細は、製造されたデータの提供を含む、特許的に偽であることが証明されました。 結論:CHATGPTは、正当なように見えるが、実際には間違っている可能性がある回答を提供します。このシステムは、質問に答えるためにデータを収集し、もっともらしいと思われる情報を作成する方法について透明ではなく、臨床的な質問の信頼性の低いツールになります。

背景:CHATGPTは、正しい単語を予測するために訓練された人工知能(AI)テキストジェネレーターであり、質問への回答を提供できますが、医学的な質問に答える際にさまざまな結果を示しています。 目的:CHATGPTの信頼性と正確性を評価するには、複雑な臨床的質問への回答を提供します。 方法:人口、介入、比較、結果、および時間(PICOT)フォーマットされた質問が照会され、参照のリクエストが尋ねられました。フルテキストの記事をレビューして、チャットボットが提供する証拠の概要の正確性を確認しました。 結果:ChatGptは、Picotの質問に証明可能な回答を提供できませんでした。証拠として引用された参考文献には、誤ったジャーナル情報が含まれており、CHATGPTによって要約された多くの研究の詳細は、製造されたデータの提供を含む、特許的に偽であることが証明されました。 結論:CHATGPTは、正当なように見えるが、実際には間違っている可能性がある回答を提供します。このシステムは、質問に答えるためにデータを収集し、もっともらしいと思われる情報を作成する方法について透明ではなく、臨床的な質問の信頼性の低いツールになります。

BACKGROUND: ChatGPT, an artificial intelligence (AI) text generator trained to predict correct words, can provide answers to questions but has shown mixed results in answering medical questions. PURPOSE: To assess the reliability and accuracy of ChatGPT in providing answers to a complex clinical question. METHODS: A Population, Intervention, Comparison, Outcome, and Time (PICOT) formatted question was queried, along with a request for references. Full-text articles were reviewed to verify the accuracy of the evidence summary provided by the chatbot. RESULTS: ChatGPT was unable to provide a certifiable response to a PICOT question. The references cited as evidence included incorrect journal information, and many study details summarized by ChatGPT proved to be patently false, including providing fabricated data. CONCLUSIONS: ChatGPT provides answers that appear legitimate but may be factually incorrect. The system is not transparent in how it gathers data to answer questions and sometimes fabricates information that looks plausible, making it an unreliable tool for clinical questions.

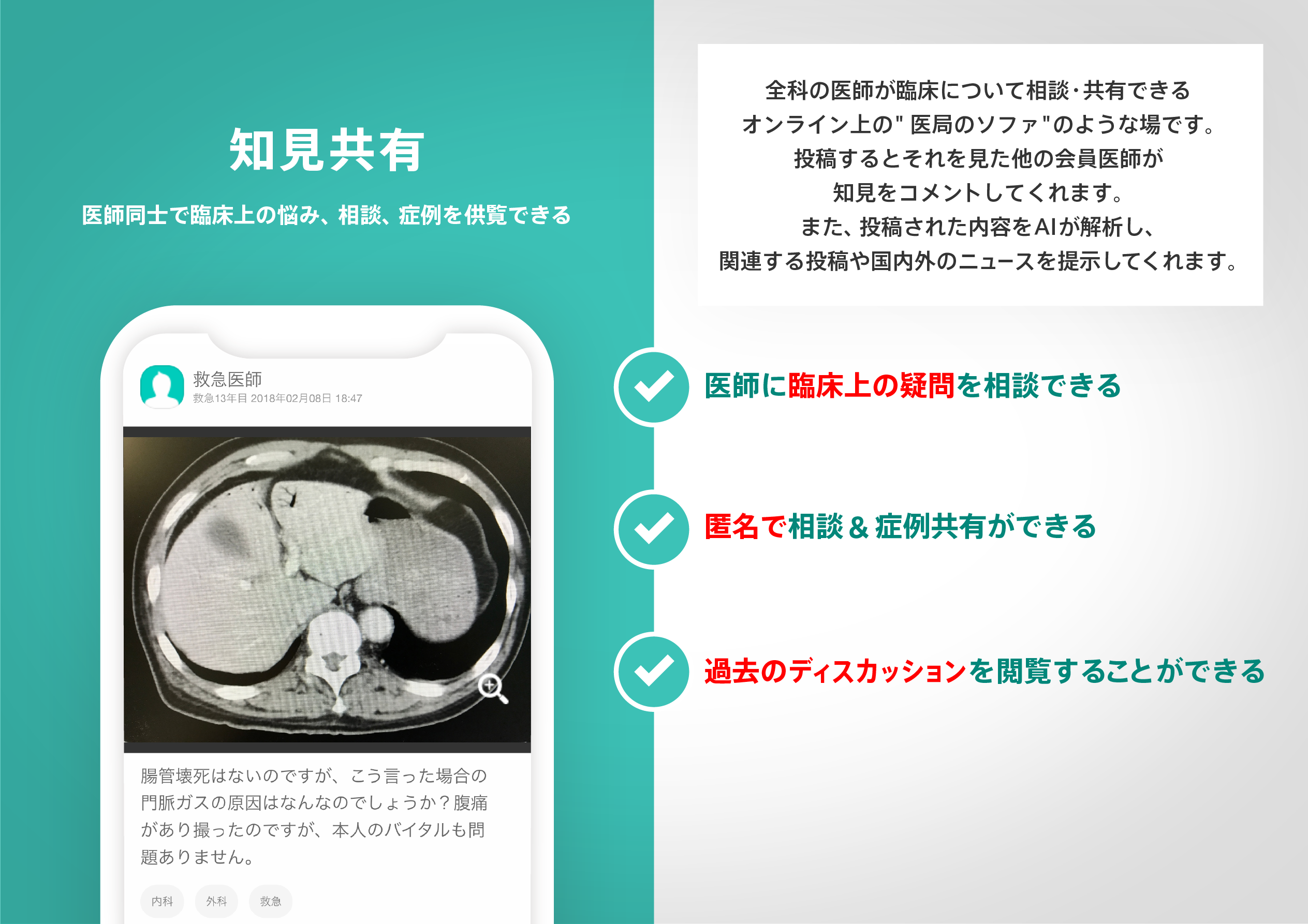

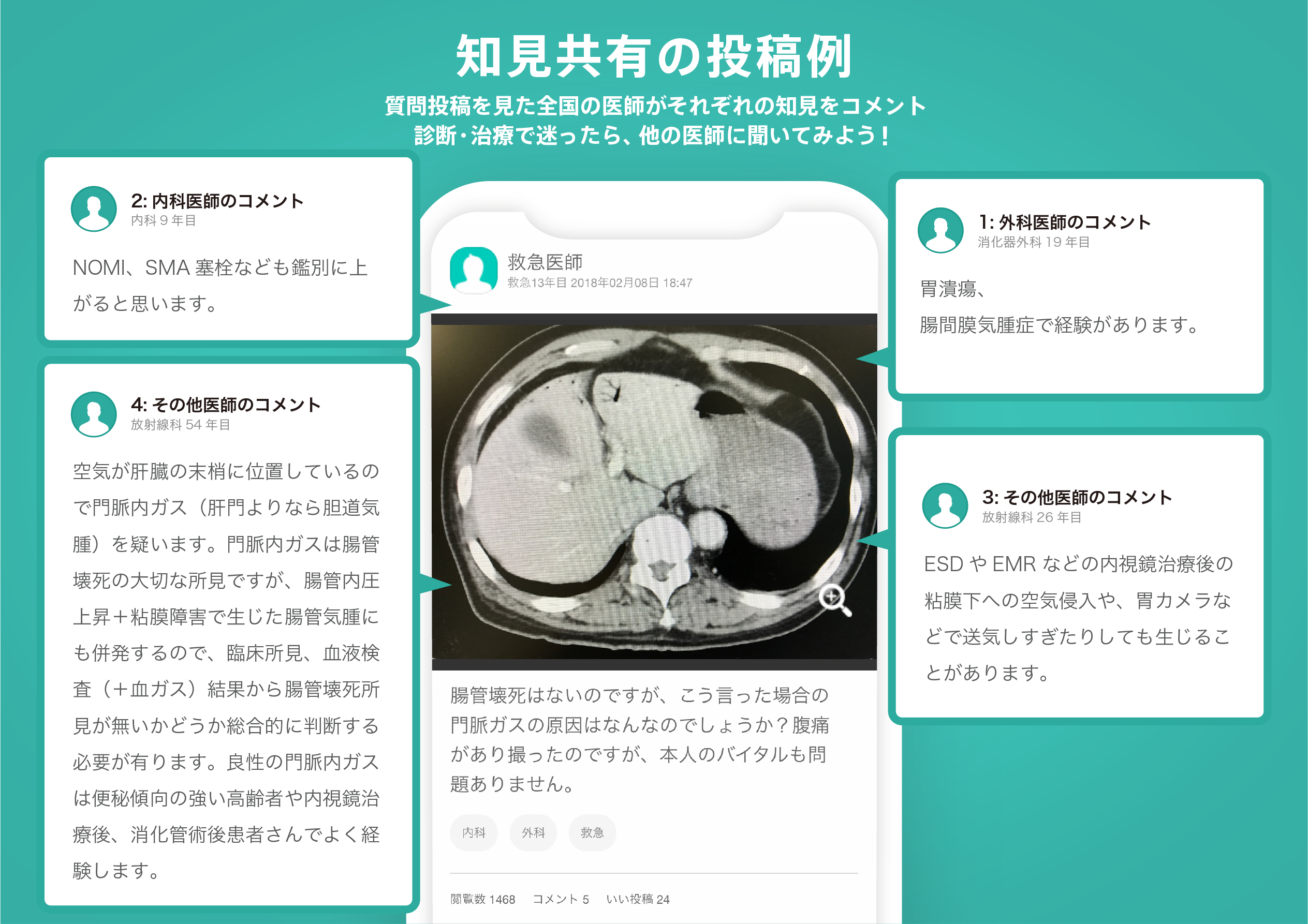

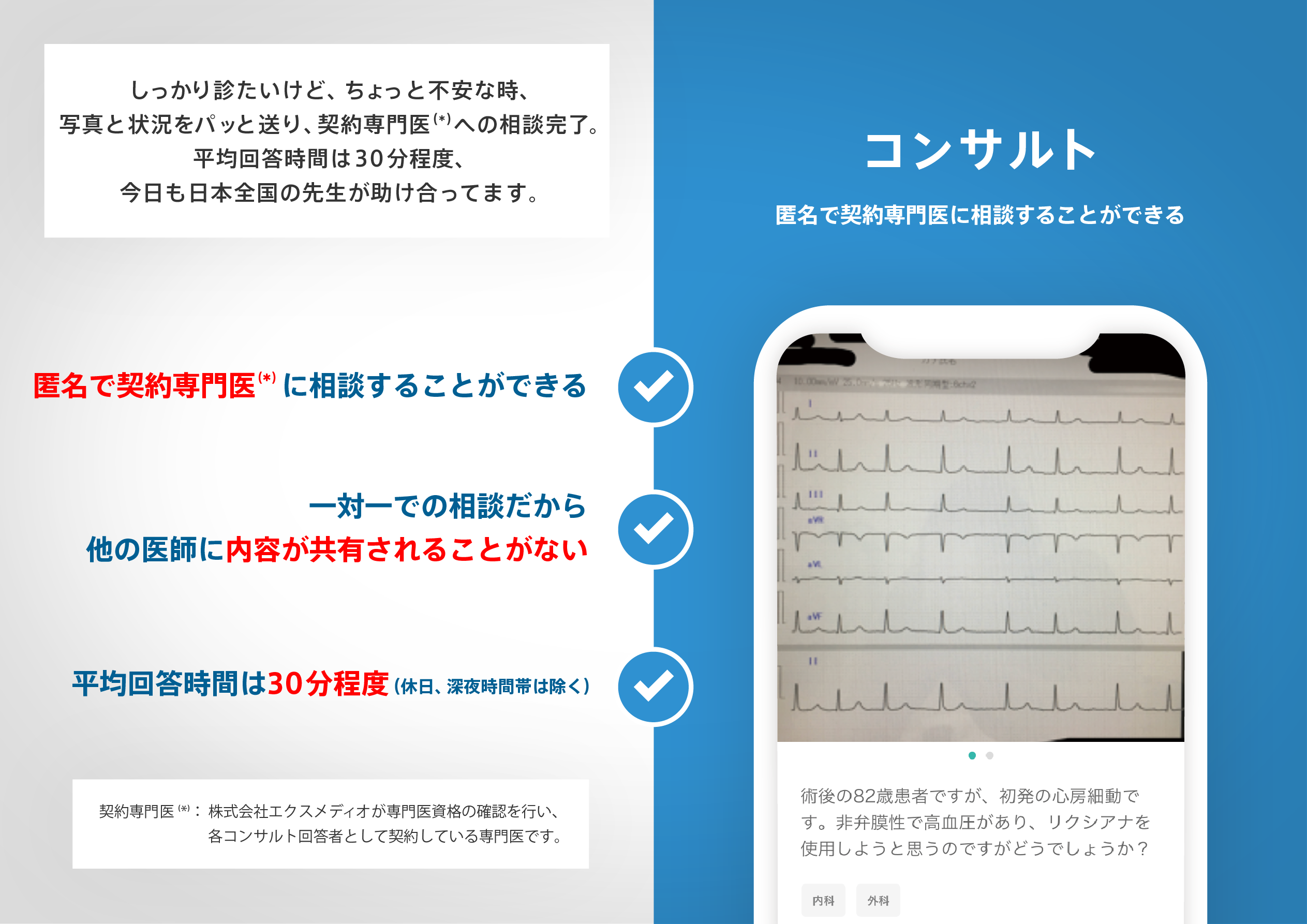

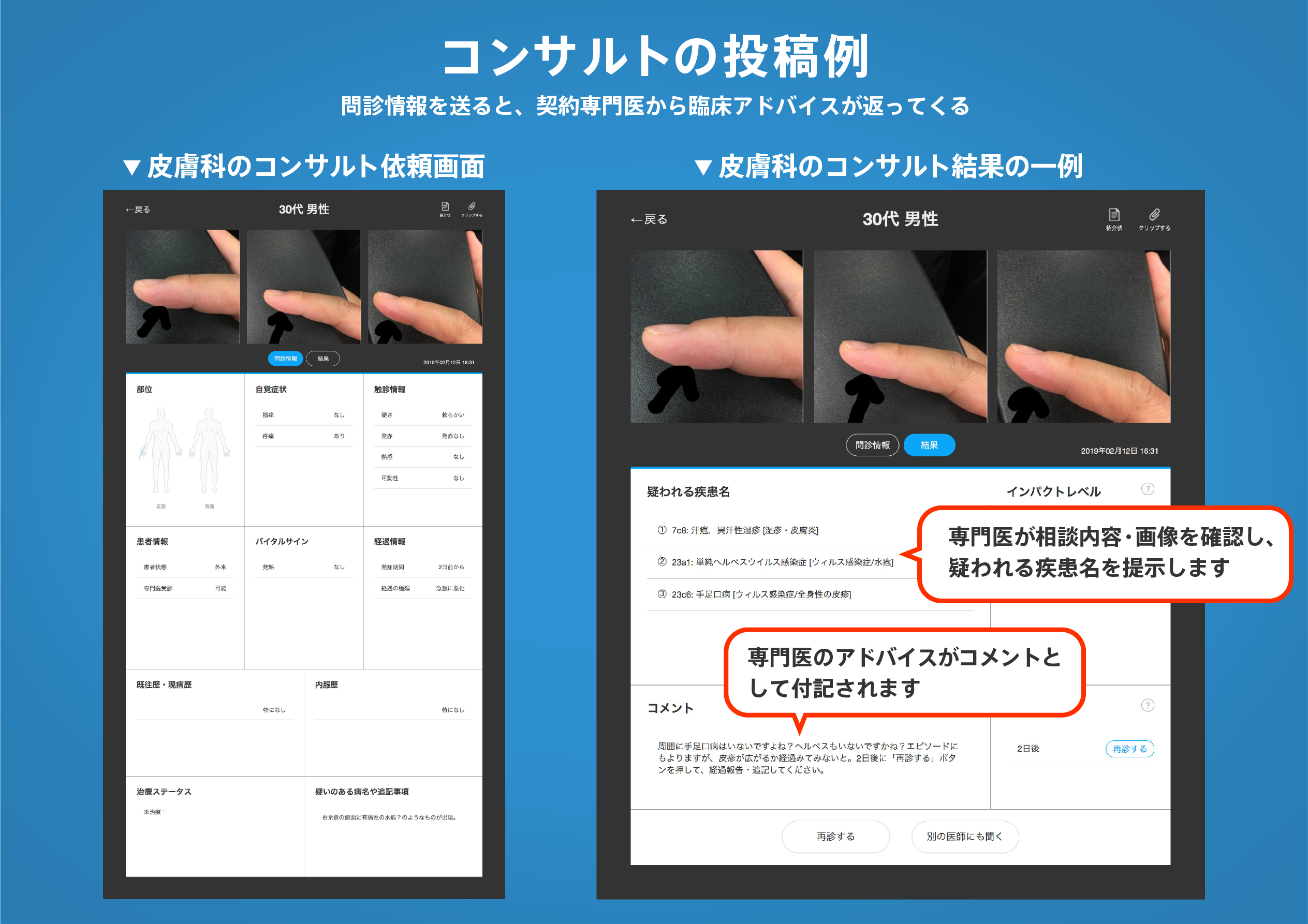

医師のための臨床サポートサービス

ヒポクラ x マイナビのご紹介

無料会員登録していただくと、さらに便利で効率的な検索が可能になります。