著名医師による解説が無料で読めます

すると翻訳の精度が向上します

ニューラル放射輝度フィールド(NERF)は、マルチビュー画像を考慮して、新しいビュー合成の大きな進歩を達成しました。最近、一部の作品は、3Dプライアーを含む単一の画像からnerfを訓練しようとしました。彼らは主に、いくつかの閉塞を備えた限られた視野に焦点を当てており、これにより、スケーラビリティは、大規模なオクルージョンを備えた現実世界の360度のパノラマシナリオに大きく制限されます。この論文では、単一のパノラマからパノラマ神経放射輝度を訓練する360度の新規ビューの合成フレームワークであるPerfを提示します。特に、Perfは、高価で退屈な画像コレクションのない複雑なシーンで3Dローミングを可能にします。この目標を達成するために、360度の2Dシーンを3Dシーンに持ち上げるための新しい共同RGBDのパインティング方法と、進歩的なインペインティングとエラシング方法を提案します。具体的には、最初にパノラマ深度マップを単一のパノラマを考慮して初期化として予測し、ボリュームレンダリングを備えた目に見える3D領域を再構築します。次に、ランダムビューからRGB画像と深度マップを完成させるために、collaborative RGBDのパインティングアプローチをNERFに導入します。これは、RGB安定性拡散モデルと単眼深度推定器から導出されます。最後に、新たにサンプリングされたビューと参照ビューの間の一貫性のないジオメトリを回避するために、インポインティングとエラーシング戦略を紹介します。2つのコンポーネントは、統一された最適化フレームワークでNERFの学習に統合され、有望な結果を達成します。レプリカと新しいデータセットのパフォーマンスに関する広範な実験は、最先端の方法よりもパフォーマーの優位性を示しています。私たちのパフォーマーは、パノラマから3D、テキストツー3D、3Dシーンスタイリゼーションアプリケーションなど、実際のアプリケーションに広く使用できます。プロジェクトページとコードは、https://github.com/perf-project/perfで入手できます。

ニューラル放射輝度フィールド(NERF)は、マルチビュー画像を考慮して、新しいビュー合成の大きな進歩を達成しました。最近、一部の作品は、3Dプライアーを含む単一の画像からnerfを訓練しようとしました。彼らは主に、いくつかの閉塞を備えた限られた視野に焦点を当てており、これにより、スケーラビリティは、大規模なオクルージョンを備えた現実世界の360度のパノラマシナリオに大きく制限されます。この論文では、単一のパノラマからパノラマ神経放射輝度を訓練する360度の新規ビューの合成フレームワークであるPerfを提示します。特に、Perfは、高価で退屈な画像コレクションのない複雑なシーンで3Dローミングを可能にします。この目標を達成するために、360度の2Dシーンを3Dシーンに持ち上げるための新しい共同RGBDのパインティング方法と、進歩的なインペインティングとエラシング方法を提案します。具体的には、最初にパノラマ深度マップを単一のパノラマを考慮して初期化として予測し、ボリュームレンダリングを備えた目に見える3D領域を再構築します。次に、ランダムビューからRGB画像と深度マップを完成させるために、collaborative RGBDのパインティングアプローチをNERFに導入します。これは、RGB安定性拡散モデルと単眼深度推定器から導出されます。最後に、新たにサンプリングされたビューと参照ビューの間の一貫性のないジオメトリを回避するために、インポインティングとエラーシング戦略を紹介します。2つのコンポーネントは、統一された最適化フレームワークでNERFの学習に統合され、有望な結果を達成します。レプリカと新しいデータセットのパフォーマンスに関する広範な実験は、最先端の方法よりもパフォーマーの優位性を示しています。私たちのパフォーマーは、パノラマから3D、テキストツー3D、3Dシーンスタイリゼーションアプリケーションなど、実際のアプリケーションに広く使用できます。プロジェクトページとコードは、https://github.com/perf-project/perfで入手できます。

Neural Radiance Field (NeRF) has achieved substantial progress in novel view synthesis given multi-view images. Recently, some works have attempted to train a NeRF from a single image with 3D priors. They mainly focus on a limited field of view with a few occlusions, which greatly limits their scalability to real-world 360-degree panoramic scenarios with large-size occlusions. In this paper, we present PERF, a 360-degree novel view synthesis framework that trains a panoramic neural radiance field from a single panorama. Notably, PERF allows 3D roaming in a complex scene without expensive and tedious image collection. To achieve this goal, we propose a novel collaborative RGBD inpainting method and a progressive inpainting-and-erasing method to lift up a 360-degree 2D scene to a 3D scene. Specifically, we first predict a panoramic depth map as initialization given a single panorama and reconstruct visible 3D regions with volume rendering. Then we introduce a collaborative RGBD inpainting approach into a NeRF for completing RGB images and depth maps from random views, which is derived from an RGB Stable Diffusion model and a monocular depth estimator. Finally, we introduce an inpainting-and-erasing strategy to avoid inconsistent geometry between a newly-sampled view and reference views. The two components are integrated into the learning of NeRFs in a unified optimization framework and achieve promising results. Extensive experiments on Replica and a new dataset PERF-in-the-wild demonstrate the superiority of our PERF over state-of-the-art methods. Our PERF can be widely used for real-world applications, such as panorama-to-3D, text-to-3D, and 3D scene stylization applications. Project page and code are available at https://github.com/perf-project/PeRF.

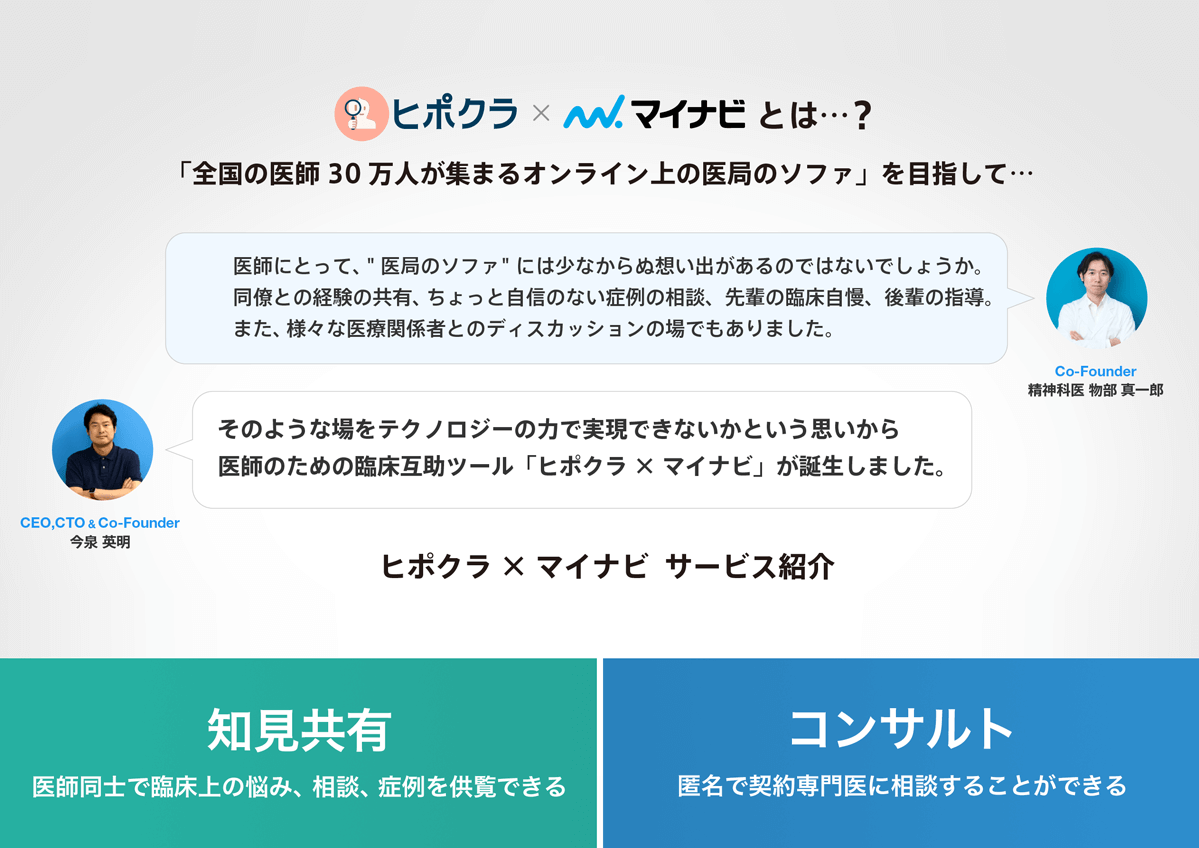

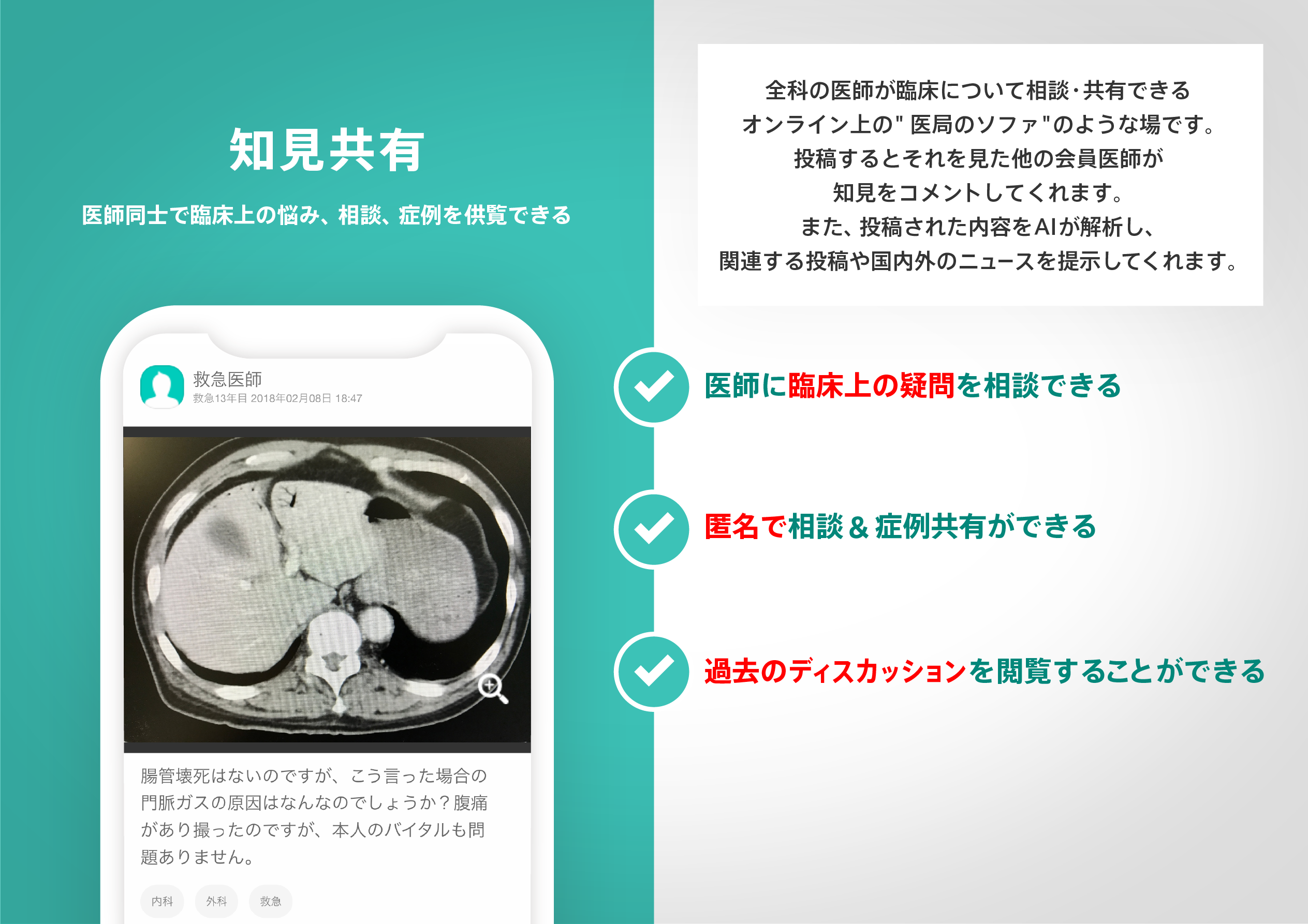

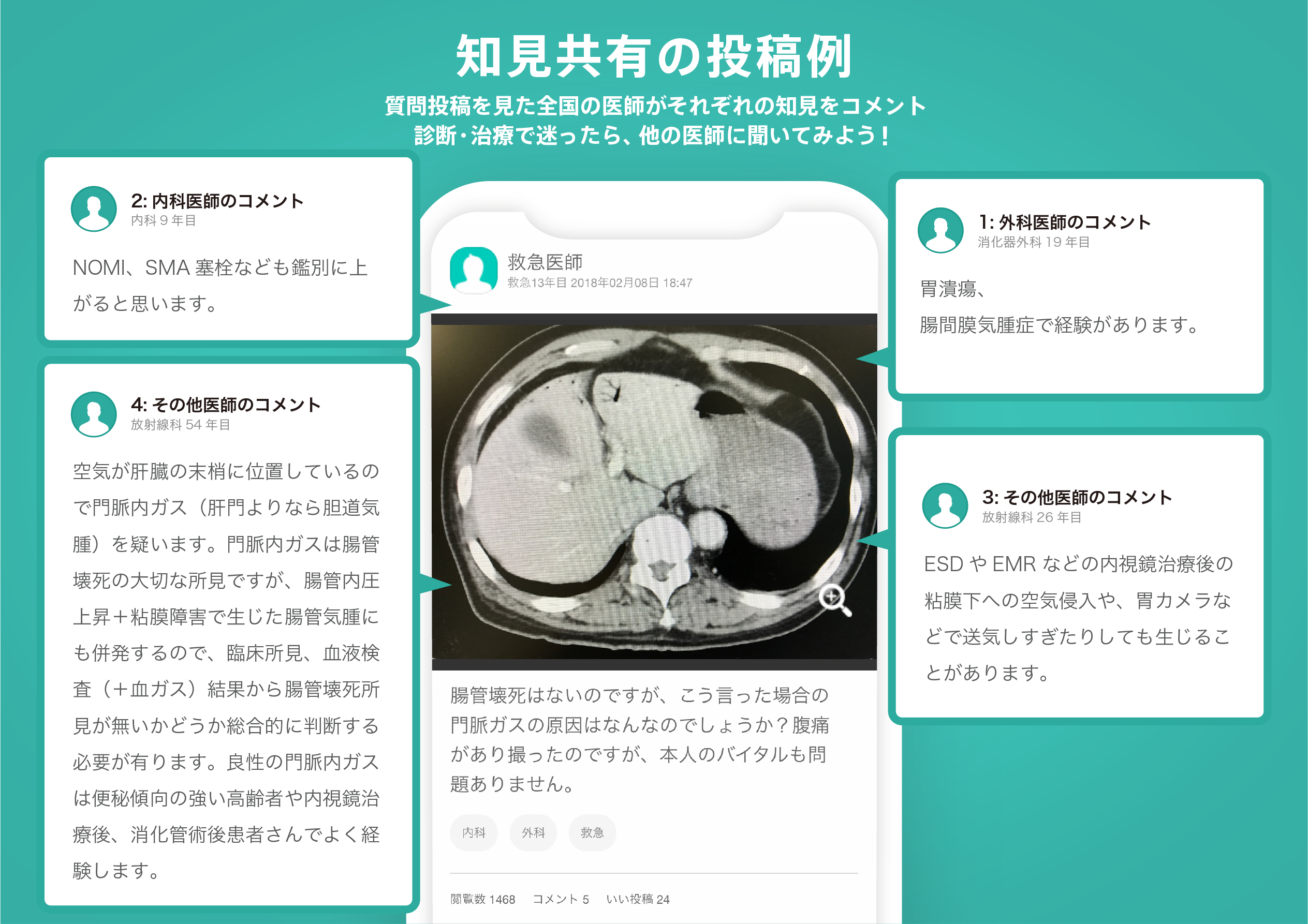

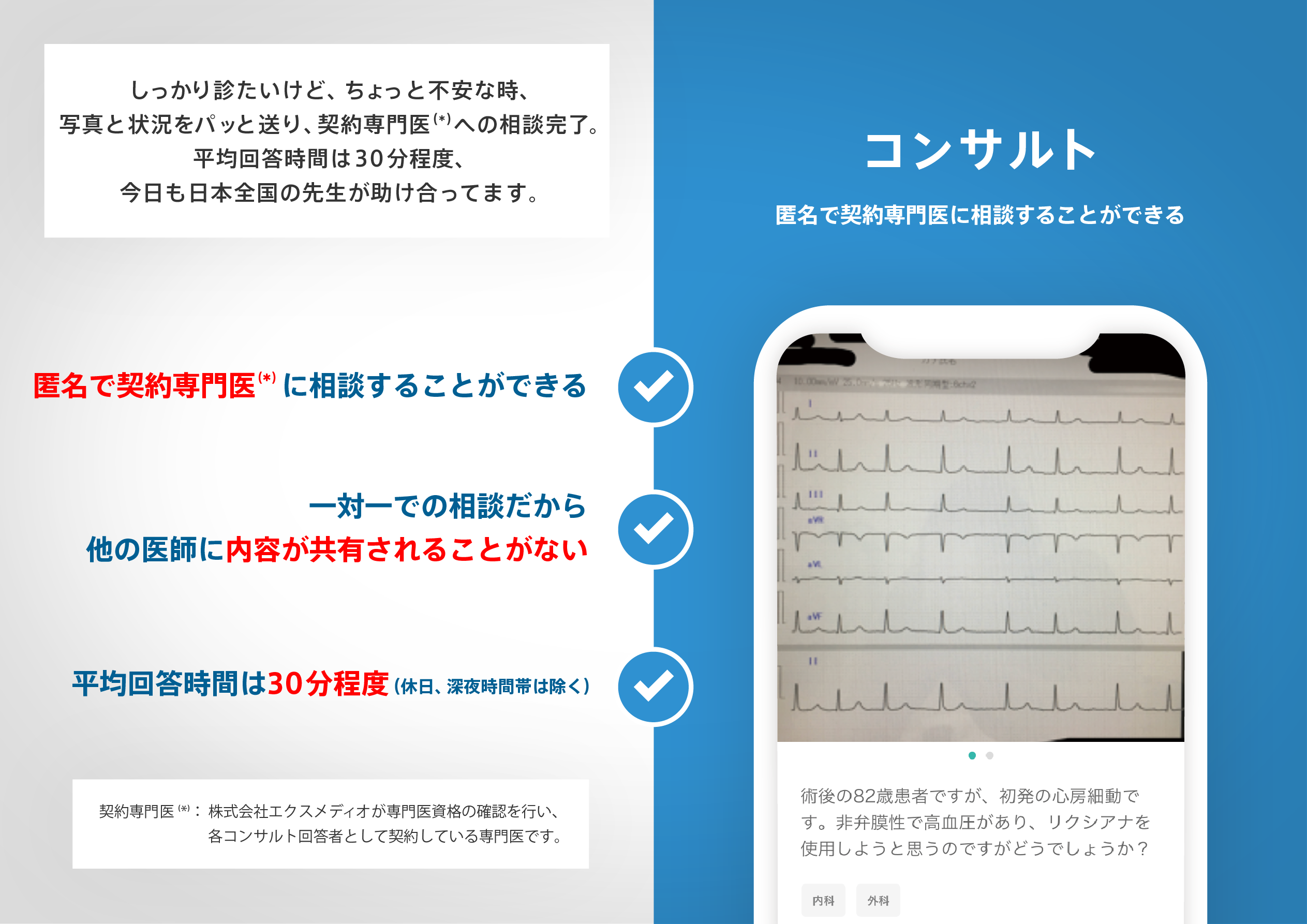

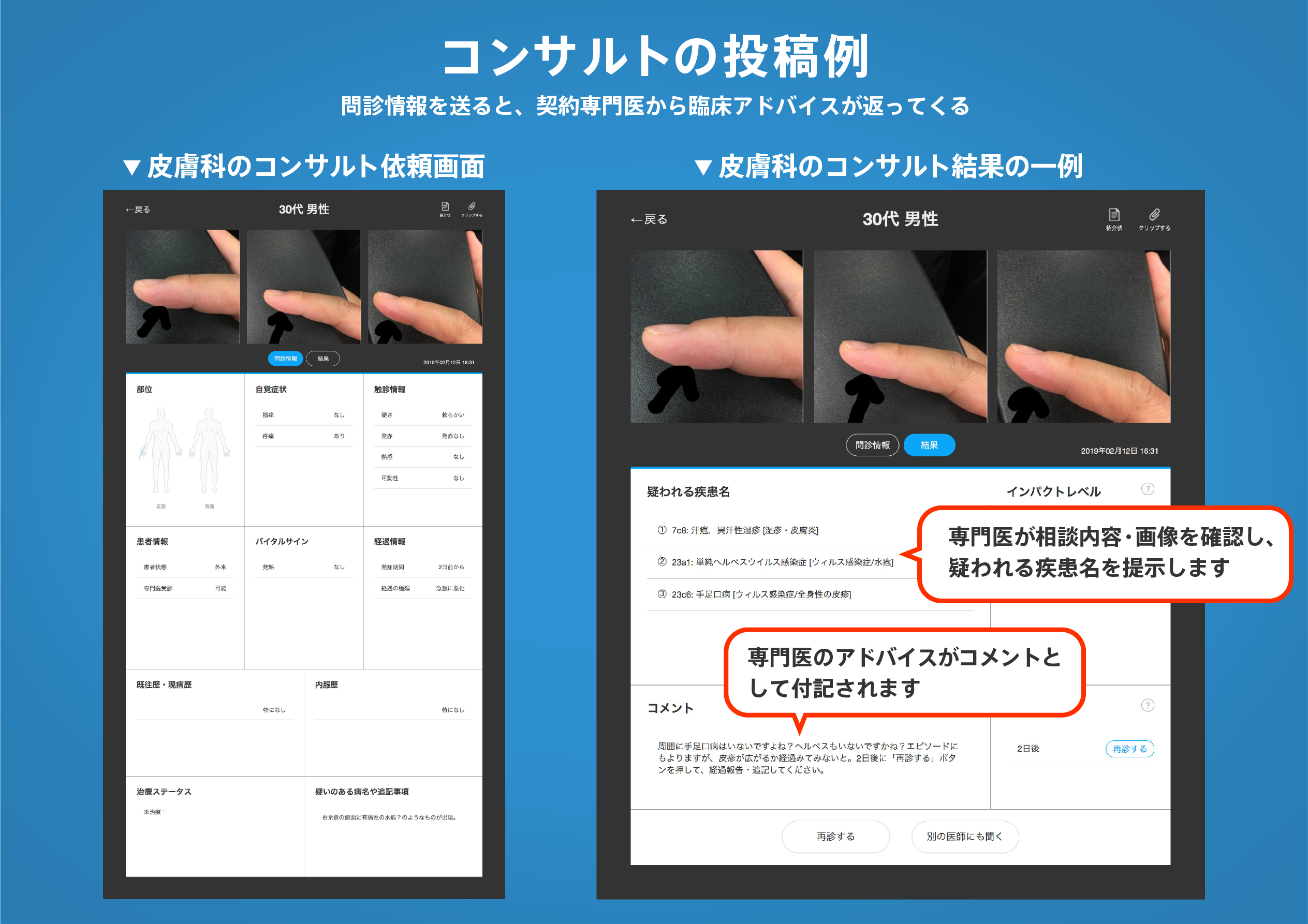

医師のための臨床サポートサービス

ヒポクラ x マイナビのご紹介

無料会員登録していただくと、さらに便利で効率的な検索が可能になります。