著名医師による解説が無料で読めます

すると翻訳の精度が向上します

ドメイン一般化(DG)は、目に見えないターゲットテストドメインに一般化できる1つまたは複数の観測されたソースドメインでモデルを学習することを目的としています。以前のアプローチは、複数のソースドメインからドメイン不変の情報を抽出することに焦点を合わせてきましたが、ドメイン固有の情報は個々のドメインのセマンティクスと密接に結びついており、ターゲットドメインへの一般化には適していません。この記事では、より効果的なDGのためにドメインインヴァリアントとドメイン固有の情報の両方を活用する連続した解き伸びジョイントスペース学習(CJSL)と呼ばれる新しいDGメソッドを提案します。CJSLの背後にある重要なアイデアは、反復的な特徴の解体を介して、ソースドメインからのドメイン固有の表現の連続的なジョイント空間(CJS)を策定して学習することです。この学習CJは、推論段階でのモンテカルロサンプリングを介して複数のドメインの混合からテストサンプルのドメイン固有の表現をシミュレートするために使用できます。ドメインに不変の機能ベクトルのみを活用するか、普遍的なドメイン固有の特徴抽出器を学習することを目的とする既存のアプローチとは異なり、テストサンプルの学習CJの潜在性ベクターをサンプリングして複数の複数のパワーを完全に使用することにより、ドメイン固有の表現をシミュレートします。堅牢な予測のためのドメイン固有の分類器。経験的結果は、CJSLが7つのベンチマークで19の最新(SOTA)メソッドを上回ることを示しており、提案された方法の有効性を示しています。

ドメイン一般化(DG)は、目に見えないターゲットテストドメインに一般化できる1つまたは複数の観測されたソースドメインでモデルを学習することを目的としています。以前のアプローチは、複数のソースドメインからドメイン不変の情報を抽出することに焦点を合わせてきましたが、ドメイン固有の情報は個々のドメインのセマンティクスと密接に結びついており、ターゲットドメインへの一般化には適していません。この記事では、より効果的なDGのためにドメインインヴァリアントとドメイン固有の情報の両方を活用する連続した解き伸びジョイントスペース学習(CJSL)と呼ばれる新しいDGメソッドを提案します。CJSLの背後にある重要なアイデアは、反復的な特徴の解体を介して、ソースドメインからのドメイン固有の表現の連続的なジョイント空間(CJS)を策定して学習することです。この学習CJは、推論段階でのモンテカルロサンプリングを介して複数のドメインの混合からテストサンプルのドメイン固有の表現をシミュレートするために使用できます。ドメインに不変の機能ベクトルのみを活用するか、普遍的なドメイン固有の特徴抽出器を学習することを目的とする既存のアプローチとは異なり、テストサンプルの学習CJの潜在性ベクターをサンプリングして複数の複数のパワーを完全に使用することにより、ドメイン固有の表現をシミュレートします。堅牢な予測のためのドメイン固有の分類器。経験的結果は、CJSLが7つのベンチマークで19の最新(SOTA)メソッドを上回ることを示しており、提案された方法の有効性を示しています。

Domain generalization (DG) aims to learn a model on one or multiple observed source domains that can generalize to unseen target test domains. Previous approaches have focused on extracting domain-invariant information from multiple source domains, but domain-specific information is also closely tied to semantics in individual domains and is not well-suited for generalization to the target domain. In this article, we propose a novel DG method called continuous disentangled joint space learning (CJSL), which leverages both domain-invariant and domain-specific information for more effective DG. The key idea behind CJSL is to formulate and learn a continuous joint space (CJS) for domain-specific representations from source domains through iterative feature disentanglement. This learned CJS can then be used to simulate domain-specific representations for test samples from a mixture of multiple domains via Monte Carlo sampling during the inference stage. Unlike existing approaches, which exploit domain-invariant feature vectors only or aim to learn a universal domain-specific feature extractor, we simulate domain-specific representations via sampling the latent vectors in the learned CJS for the test sample to fully use the power of multiple domain-specific classifiers for robust prediction. Empirical results demonstrate that CJSL outperforms 19 state-of-the-art (SOTA) methods on seven benchmarks, indicating the effectiveness of our proposed method.

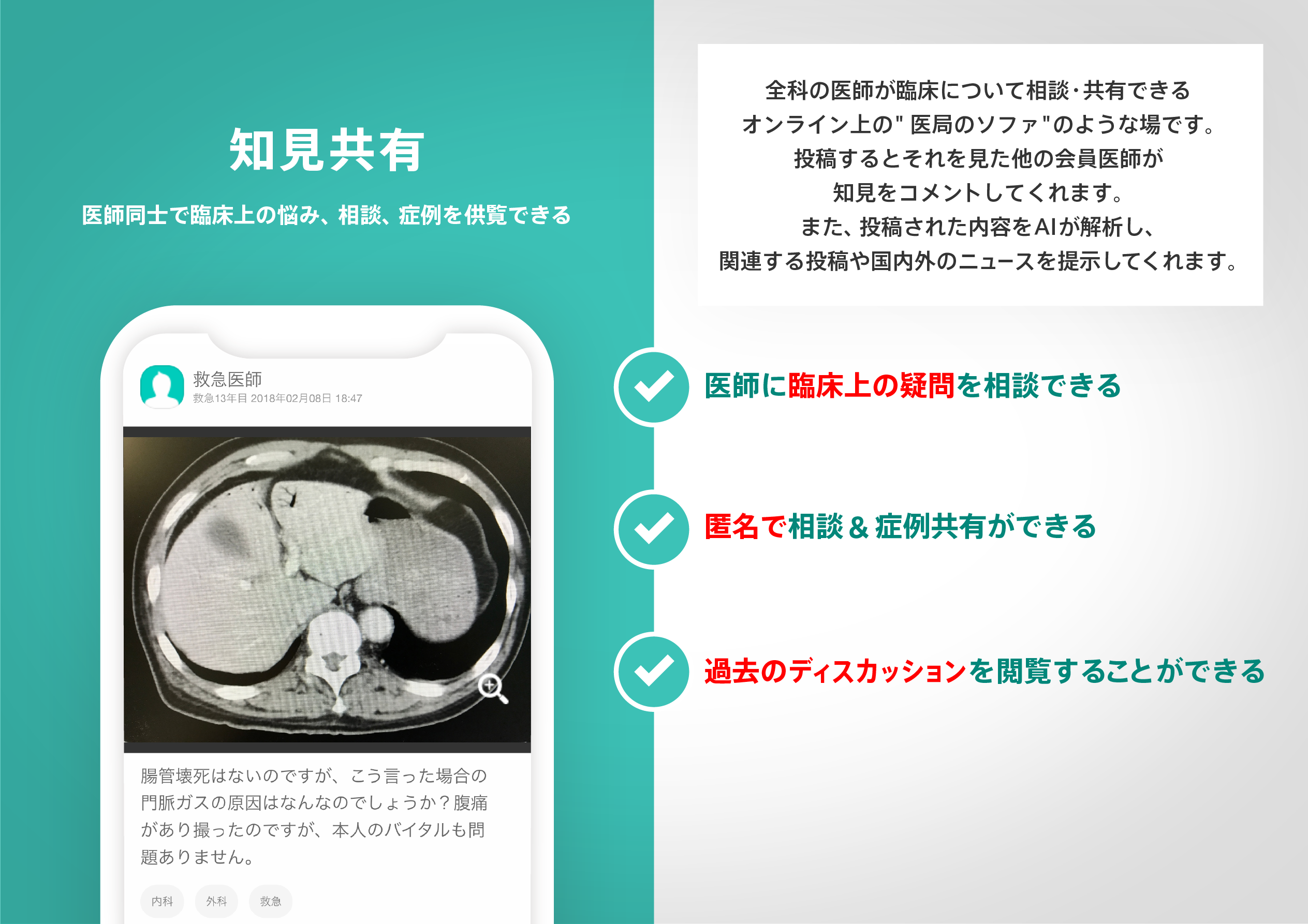

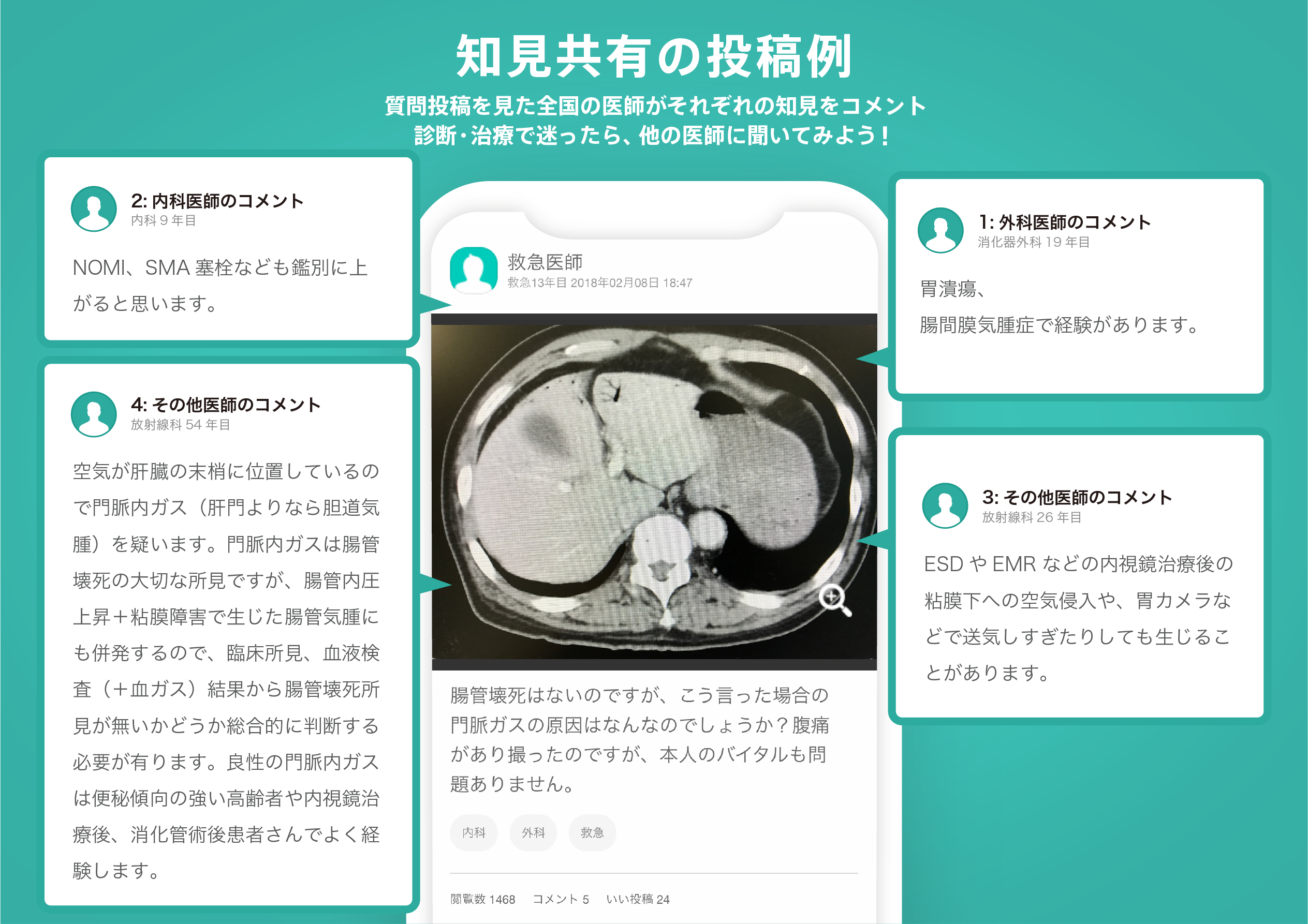

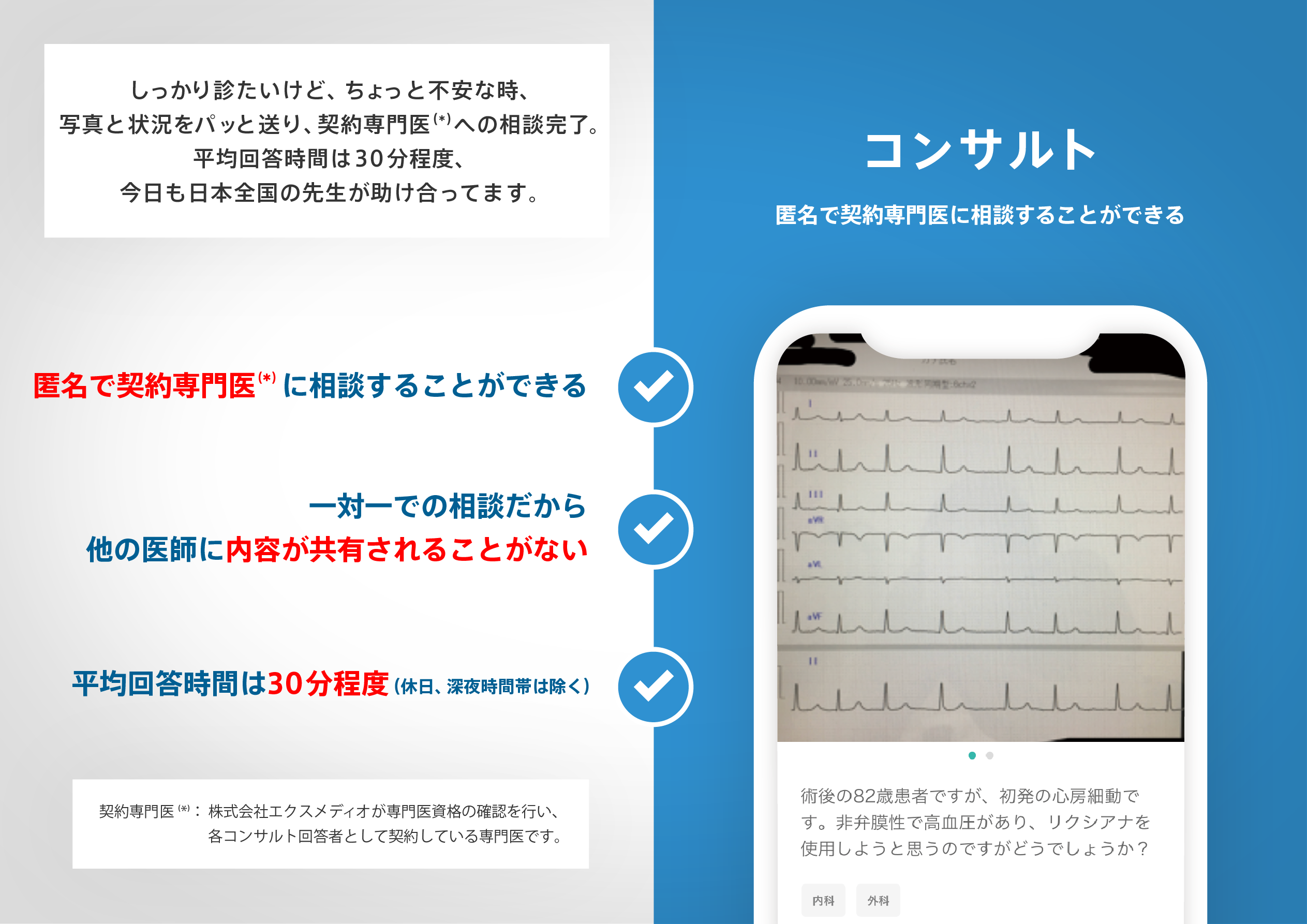

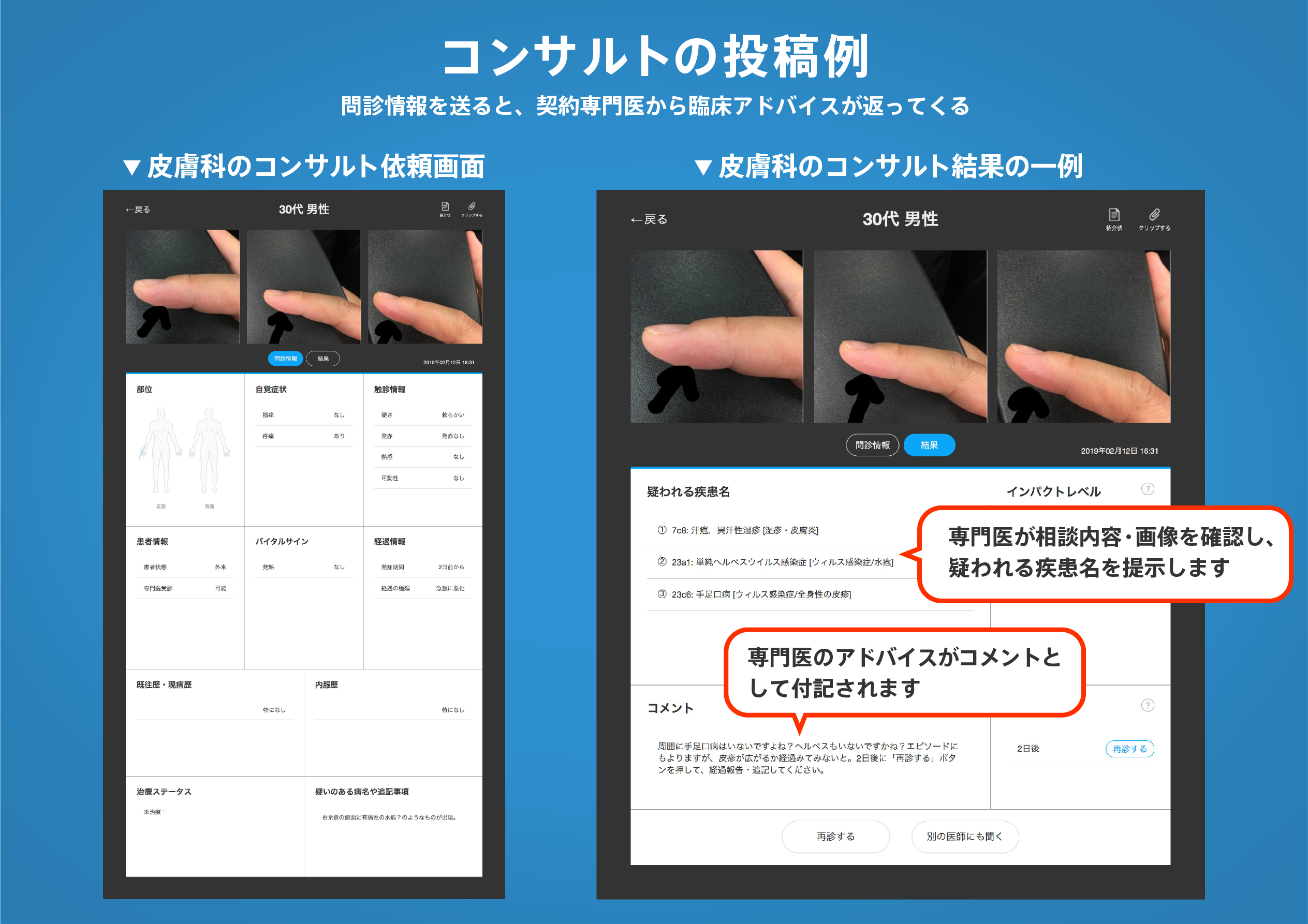

医師のための臨床サポートサービス

ヒポクラ x マイナビのご紹介

無料会員登録していただくと、さらに便利で効率的な検索が可能になります。